SEO用語集とは、SEO対策で頻出する専門用語の意味を、実務で使える粒度でまとめた一覧です。

Webマーケティングを始めたばかりの段階では、1つの用語を調べても、その説明の中に別の専門用語が出てきて、理解が進みにくいことがあります。

このページは、SEO対策をこれから学ぶ方や、実務で使う言葉を整理し直したい方向けに、2026年時点の考え方で用語集としてまとめたものです。

見慣れないSEO用語に出会ったときにすぐ引けるよう、ページ内検索も活用しながら読み進めてみてください(WindowsならCtrl+F、Macなら⌘ command + F)。ジャンル別に50音順で整理しているので、必要な言葉を探しやすい構成です。SEO用語集を手元に置きながら、基礎から整理していきましょう。

本記事の作成方針について

本記事は、当社EXIDEAでオールインワンSEOツール「EmmaTools」を提供し、SEOメディア「EmmaMagazine」を運用してきた知見をベースに、生成AIを編集補助として活用して作成しています。AIが生成したテキストをそのまま公開することはせず、編集者がEXIDEA独自のクライアント支援知見、現場での用語の使われ方、最新のSEOアルゴリズム動向を踏まえた解釈を追加し、ファクトチェックを行ったうえで公開しています。

SEO用語は時代とともに意味や重要度が変わるため、2026年時点の実務感覚で「いま何を押さえればいいのか」を編集判断しています。

この記事でわかること

- 1 動画でわかるSEO用語集の全体像

- 2 基本的なSEO用語

- 2.1 アルゴリズム

- 2.2 インデックス

- 2.3 SEO(Search Engine Optimization)

- 2.4 オーガニック検索(自然検索)

- 2.5 オフページSEO

- 2.6 オンページSEO(内部施策)

- 2.7 Googleが掲げる10の事実

- 2.8 クローラー

- 2.9 クローラビリティ

- 2.10 クローリング

- 2.11 コンテンツSEO

- 2.12 コンバージョン(CV)

- 2.13 SERP / SERPs(Search Engine Result Pages)

- 2.14 サイテーション

- 2.15 サジェスト

- 2.16 指名検索

- 2.17 スニペット

- 2.18 テクニカルSEO

- 2.19 ドメインパワー

- 2.20 AI Overview(AIオーバービュー)

- 2.21 BERT

- 2.22 ユーザビリティ

- 2.23 リダイレクト

- 2.24 ローカルSEO

- 2.25 CTR(Click Through Rate)

- 2.26 CVR(Conversion Rate / コンバージョン率)

- 2.27 SEM(Search Engine Marketing)

- 2.28 MEO(Map Engine Optimization)

- 2.29 PAA(People Also Ask)

- 2.30 Webマーケティング

- 2.31 コンテンツマーケティング

- 2.32 オウンドメディ���

- 2.33 カスタマ��ジャーニー

- 2.34 セマンティック検索

- 2.35 コアアップデート

- 3 サイトに関するSEO用語

- 3.1 アンカーテキスト

- 3.2 AMP

- 3.3 H1

- 3.4 SSL化

- 3.5 altタグ(オルトタグ)

- 3.6 canonicalタグ(カノニカル)

- 3.7 強調スニペット

- 3.8 グローバルナビゲーション

- 3.9 構造化データ

- 3.10 サイトマップ

- 3.11 サブディレクトリ

- 3.12 サブドメイン

- 3.13 301リダイレクト

- 3.14 302リダイレクト

- 3.15 CSS

- 3.16 タイトル

- 3.17 ディスクリプション

- 3.18 ドメイン

- 3.19 noindex

- 3.20 nofollow

- 3.21 パーマリンク

- 3.22 パンくずリスト

- 3.23 ファビコン

- 3.24 URLの正規化

- 3.25 リッチリザルト

- 3.26 レスポンシブ

- 3.27 robots.txt

- 3.28 aタグ(アンカータグ���

- 3.29 hタグ(見出しタグ)

- 3.30 meta refresh(メタリフレッシュ)

- 3.31 ページネーション

- 3.32 Web��イト

- 3.33 FAQ構造化データ

- 3.34 EFO(Entry Form Optimization)

- 3.35 LPO(Landing Page Optimization)

- 3.36 Webサイト

- 3.37 ドメインエイジ

- 4 キーワードに関するSEO用語

- 5 コンテンツに関するSEO用語

- 6 リンクに関するSEO用語

- 7 SEOでやってはいけないことに関する用語

- 8 ツールやサイトに関する用語

- 9 その他

- 10 当社EXIDEAが考えるSEO用語の身につけ方

- 11 よくある質問

- 12 まとめ

動画でわかるSEO用語集の全体像

記事の要点を先に動画で掴みたい方は、以下をご覧ください。(動画をクリックすると音声が出ます)

基本的なSEO用語

これからサイトを作成し、SEOを始めるなら、まずは検索の仕組みと評価の土台になる用語から押さえることが重要です。ここを曖昧にしたまま施策に入ると、何を改善しているのか判断しにくくなります。

アルゴリズム

一般的なアルゴリズムとは計算手順や処理手順を指しますが、SEOではGoogleの検索アルゴリズムのように、検索意図に合うページを選び並べる仕組みを意味します。

SEOにおけるアルゴリズムは、単純にキーワードが入っているページを選ぶものではなく、検索意図、内容の有用性、ページの理解しやすさ、信頼性など複数の要素を組み合わせて評価します。昨今は特に、情報量だけでなく「そのページで答える意味があるか」が問われやすくなっています。

Googleは年に数回、コアアルゴリズムアップデートと呼ばれる大きな更新を実施し、検索結果の順位が大きく変動することがあります。アップデートの影響を受けた場合は、慌てて記事を削除するのではなく、2〜4週間の推移を見てから対応を判断するのが実務的です。

インデックス

インデックスとは、作成したサイトやページが検索エンジンのデータベースに登録されることを指す用語です。

検索結果に表示されるのは、基本的にインデックスされたページです。つまり、公開しただけでは十分ではなく、まず検索エンジンに見つけてもらい、内容を理解してもらう必要があります。

実務では「公開したのに順位が付かない」と相談されるケースがありますが、原因がコンテンツ品質ではなく、そもそも未インデックスということも少なくありません。まずは表示されない理由が評価の問題なのか、登録前の問題なのかを切り分けることが大切です。

⇒インデックスの詳細は、インデックスとは?確認方法や登録方法、SEOへの影響で詳しく解説しています。

SEO(Search Engine Optimization)

SEOはSearch Engine Optimizationの略語で、日本語では「検索エンジン最適化」を意味します。

SEOとは、GoogleやBingなどの検索エンジンで、特定のテーマを調べたユーザーに対して、自社サイトのページを見つけてもらいやすくする取り組みです。単に上位表示を目指すだけでなく、適切な検索語句で、適切なページに、適切なユーザーを集めることまで含めて考える必要があります。

SEO対策では、ユーザーの役に立つコンテンツを前提に、その内容を検索エンジンが理解しやすい形に整えることが基本です。

(参照:Google 公式 SEO スターター ガイド)

オーガニック検索(自然検索)

オーガニック検索とは、Googleなどの検索結果画面に表示されるページのうち、広告を除いた自然検索枠を指します。

具体的には、URLの近くに「広告」や「スポンサー」の表示がない掲載枠が該当します。オーガニック検索の順位は広告費ではなく、検索エンジンの評価によって決まるため、SEO対策の主戦場になります。

オーガニック検索からの流入は、広告費をかけずに継続的なアクセスを得られる点が大きなメリットです。Google Search Consoleで「検索パフォーマンス」を見ると、オーガニック検索での表示回数やクリック数を確認できます。広告枠の拡大やAI Overviewの導入により、オーガニック検索枠の視認性が変化しているため、CTRの推移を定期的にモニタリングすることが重要です。

オフページSEO

オフページSEOとは、自社サイトの外側にある要素によって評価を高めるSEO施策のことで、外部施策とも呼ばれます。

代表例は被リンクやブランド名の言及です。自社サイトと関連性の高い外部サイトから紹介されると、検索エンジンにとっても「他者から参照される価値があるサイト」と判断しやすくなります。

日本では、良い記事を作れば自然に大量の被リンクが集まるとは限りません。実務では、調査データ、独自見解、図解、一次情報のように「紹介する理由がある素材」を用意したうえで、発信や広報まで含めて設計するほうが現実的です。

オンページSEO(内部施策)

オンページSEOとは、サイト内で行う施策を指し、内部施策とも言います。

オンページSEOには、コンテンツの作成、見出し構造の整理、タイトルやディスクリプションの最適化、URLの正規化、内部リンク設計などが含まれます。ページ単体の質だけでなく、検索エンジンが内容を理解しやすい構造にすることが重要です。

実務での優先順位としては、まずタイトルとH1の最適化、次にメタディスクリプションの設定、内部リンクの整理、ページ表示速度の改善という順で着手するのが効率的です。オンページSEOは自社でコントロールできる領域が大きいため、外部施策より先に整備することが推奨されます。

Googleが掲げる10の事実

Googleが掲げる10の事実は、Googleの考え方を示す有名な原則群として知られてきた内容です。

- ユーザーに焦点を絞れば、他のものはみな後からついてくる。

- 1つのことをとことん極めてうまくやるのが一番。

- 遅いより速いほうがいい。

- ウェブ上の民主主義は機能します。

- 情報を探したくなるのはパソコンの前にいるときだけではない。

- 悪事を働かなくてもお金は稼げる。

- 世の中にはまだまだ情報があふれている。

- 情報のニーズはすべての国境を越える。

- スーツがなくても真剣に仕事はできる。

- 「すばらしい」では足りない。

現在のSEO実務では、この10項目をそのまま暗記することよりも、「ユーザーに役立つことを優先する」という発想を施策判断に落とし込むことが大切です。たとえば、CTRを上げたいからといって内容とかけ離れたタイトルを付けるのは、短期的にクリックが増えても長続きしません。

クローラー

クローラーとは、GoogleやBingなどの検索エンジンが、Web上のページを巡回して情報を収集する自動プログラムです。

HTMLだけでなく、CSS、JavaScript、画像なども含めてページを理解しようとします。SEOでは、クローラーが重要ページにたどり着けること、必要な情報を取得できることが前提になります。

代表的なクローラーにはGooglebot、Bingbot、Baidubot(百度)などがあります。クローラーの巡回頻度はサイトの更新頻度や重要度によって異なり、大規模サイトではクロールバジェットの管理が重要になります。robots.txtやサイトマップの設定で巡回を適切に制御することが、SEOの基本的な技術対応です。

クローラビリティ

クローラビリティとは、クローラーがサイト内を巡回しやすい状態、または巡回しやすくするための考え方を指します。

クローラビリティが高いサイトでは、重要ページが見つかりやすく、更新も把握されやすくなります。内部リンク、XMLサイトマップ、URL構造、不要ページの整理などが主な改善ポイントです。

特にページ数が多いサイトでは、すべてのURLを均等に見てもらえるわけではありません。ECで色違いの靴ページが大量にある、地域名だけ差し替えた店舗ページが多数ある、といった状態では、重要ページにクロールが集まりにくくなることがあります。

⇒クローラビリティの詳細は、クローラビリティとは?SEOにおける重要性と向上させる11つの方法で詳しく解説しています。

クローリング

クローリングとは、検索エンジンのクローラーがWebサイトを巡回し、情報を収集することです。

クローリングされなければ、ページ内容を把握してもらえず、結果としてインデックスや順位評価にも進みにくくなります。新規公開ページだけでなく、更新した既存ページも、まずは再クロールされる必要があります。

実務では、Google Search Consoleの「クロールの統計情報」でクロール状況を確認できます。クローリング頻度が極端に低い場合は、サイトマップの送信、内部リンクの改善、不要なURLの整理などで改善を図ります。JavaScriptで生成されるコンテンツはクローリング時に正しく取得されない場合があるため、サーバーサイドレンダリングの検討も重要です。

コンテンツSEO

コンテンツSEOとは、検索意図に合った有用なコンテンツを継続的に作成・改善し、自然検索からの流入を増やす施策です。

広告費をかけずに接点を増やせる点が魅力ですが、単に記事本数を増やせば成果が出るわけではありません。検索意図に合う切り口、他のページより具体的な説明、更新の継続まで含めて運用する必要があります。

当社でもコンテンツ改善では、共起語を増やすことより、読者が次に抱く疑問まで先回りして答えられているかを重視しています。AIで下書きを作りやすくなった分、ありきたりな説明だけの記事は伸びにくくなっているためです。

コンバージョン(CV)

コンバージョン(CV)とは、サイトに訪れたユーザーが、問い合わせや購入、資料請求などの目標行動を完了することです。

SEOでは流入数が注目されがちですが、最終的に事業成果へつながるかを見るにはCVが欠かせません。アクセスが増えてもCVが増えない場合は、キーワード選定、ページ内容、CTA設計のどこかにズレがある可能性があります。

コンバージョンの定義はサイトの目的によって異なります。ECサイトなら購入完了、BtoBサイトなら資料請求や問い合わせ、メディアサイトなら会員登録やメルマガ登録などがCVに設定されます。マイクロコンバージョン(中間CV)を設定することで、最終CVに至る前の行動も計測でき、改善ポイントが見つけやすくなります。

SERP / SERPs(Search Engine Result Pages)

SERPとは、検索エンジンでキーワードを調べたときに表示される検索結果画面のことです。

SERPには自然検索だけでなく、広告、画像、動画、ローカル情報、強調スニペットなど様々な要素が含まれます。順位だけを見ていても流入変化の理由が分からないことがあり、実際の検索結果画面を確認することが重要です。

順位は維持しているのにクリック数が落ちるケースでは、検索結果の上部に別要素が増えていることがあります。BtoC領域では特に、モバイルで最初の1画面に何が見えるかまで確認したいところです。

SERPの構成要素は年々多様化しており、強調スニペット、ナレッジパネル、ローカルパック、画像カルーセル、動画、PAA(他の人はこちらも質問)、AI Overviewなどが表示されるようになっています。SEO実務では、狙うキーワードのSERPを実際に確認し、自社ページがどの位置・形式で表示されるかを把握することが戦略立案の第一歩です。

サイテーション

サイテーションとは、サイト名やブランド名、商品名などが外部サイトやSNS、掲示板などで言及されることを指します。

リンク付きでなくても、継続的に名前が挙がることは認知や信頼のシグナルになりえます。特にローカルSEOやブランド検索の文脈では、被リンクとは別に見ておきたい概念です。なお、SNSはX(旧Twitter)なども含めて考えると分かりやすいです。

実務でサイテーションを増やすには、プレスリリース配信、SNSでの情報発信、業界イベントへの登壇などが有効です。NAP情報(Name・Address・Phone)の表記をサイト間で統一しておくと、検索エンジンが同一事業者であると認識しやすくなります。サイテーションはリンクがなくても評価に影響するとされるため、被リンク施策と並行して取り組む価値があります。

サジェスト

サジェストとは、検索エンジンが検索窓に入力された語句に関連して、候補キーワードを自動表示する機能です。

例えば、Google検索で「SEO」と入力した際に表示される「seo対策とは」や「seoとは わかりやすく」がサジェストに該当します。

サジェストは、ユーザーが実際にどのような言い回しで情報を探しているかを知るヒントになります。ただし、そのまま記事タイトルに使うのではなく、検索意図まで確認して扱うことが大切です。

実務でのサジェスト活用法としては、キーワード選定の初期段階で検索窓に軸キーワードを入れ、表示されるサジェストを網羅的に収集する方法があります。ラッコキーワードやUbersuggestなどのツールを使うと、サジェストキーワードを一括で取得できます。ただし、サジェストに表示される=検索ボリュームが大きいとは限らないため、検索ボリュームの確認も合わせて行いましょう。

指名検索

指名検索とは、企業名、サービス名、商品名など固有名詞を含めて検索することです。

例えば、「Amazon」や「吉野家」、「iPhone」のようなキーワードでの検索が該当します。比較検討が進んだユーザーが行うことも多く、コンバージョンに近い検索になりやすいのが特徴です。

指名検索が増えることは、ブランド認知が高まっている証拠です。SEOの観点では、指名検索のCTRは非常に高く、CVRも一般キーワードより高い傾向があります。指名検索を増やすには、広告・PR・SNS・イベントなどオフラインも含めた認知施策が必要であり、SEO単体では限界がある領域です。

スニペット

スニペットとは、検索結果画面でタイトルの下に表示されるページ説明文のことです。

検索エンジンはページ内容や検索語句との関連性をもとに表示文を生成します。設定したメタディスクリプションがそのまま使われるとは限りませんが、ページ内容を適切に要約しておくとクリック判断を助けやすくなります。

Google Search Consoleの検索パフォーマンスレポートで、各ページのCTRを確認し、順位に対してCTRが低い場合はスニペットの見え方に課題がある可能性があります。メタディスクリプションに検索意図への回答を含め、具体的な数字やベネフィットを入れると、クリックされやすくなる傾向があります。

テクニカルSEO

テクニカルSEOとは、検索エンジンがページを見つけ、理解し、評価しやすいようにサイトの技術面を整える施策です。

具体的には、クロール制御、インデックス制御、内部リンク、表示速度、モバイル対応、構造化データ、正規化などが含まれます。コンテンツが良くても、技術面で評価を受けにくい状態なら成果は伸びにくくなります。

実務では、テクニカルSEOは「順位を上げる魔法」ではなく、評価を妨げる要因を外す作業として捉えると分かりやすいです。特にCMS移行後やリニューアル後は、内容より先に技術的なズレが足を引っ張ることがあります。

ドメインパワー

ドメインパワーとは、サイト全体が外部・内部の要素を通じてどれだけ評価を蓄積しているかを表す、実務上よく使われる概念です。

Googleの公式指標ではありませんが、長期的に有用なコンテンツを公開し、適切な被リンクや言及を獲得しているサイトほど、新規ページも評価されやすい傾向があります。とはいえ、ドメインが強ければ何を書いても上がるわけではなく、ページ単位の関連性は依然として重要です。

実務ではAhrefsのDR(Domain Rating)やMozのDA(Domain Authority)などの指標で間接的に把握されることが多いです。ドメインパワーを高めるには、質の高い被リンク獲得、継続的なコンテンツ更新、サイト運営年数の蓄積などが関係します。新規ドメインでも、特定の領域に絞った専門性の高いコンテンツを積み上げることで、比較的早く評価を獲得できる場合があります。

AI Overview(AIオーバービュー)

AI Overviewとは、Googleが検索結果の上部にAIで生成した要約文を表示する機能で、旧称はSGE(Search Generative Experience)です。

2026年時点では日本語を含む多くの言語で展開されており、情報収集型のクエリを中心に表示される傾向があります。AI Overviewが表示されると、従来の1位ページよりも上に要約が出るため、オーガニック検索のクリック率に影響することがあります。

SEO実務では、AI Overviewに引用されやすいページの傾向を把握しておくことが重要です。見出し直下で結論を簡潔に示す構成、構造化データの適切な実装、E-E-A-Tの明示など、従来の強調スニペット対策と重なる部分が多いです。一方で、AI Overviewが表示されるクエリでは従来よりクリックが減る傾向もあるため、指名検索やCV直結キーワードの重要度が相対的に増しています。

BERT

BERTとは、自然言語処理技術の一つで、検索語句や文章の文脈理解を高めるために使われてきた仕組みです。

単語単位ではなく前後関係を踏まえて意味を捉えやすくなったことで、検索エンジンはより自然な言い回しや会話調のクエリにも対応しやすくなりました。現在はBERT単体を意識するより、「不自然なキーワード詰め込みではなく、自然で意味の通る文章を書く」ことが重要です。

BERTの導入以降、「○○ から ○○ への行き方」のような前置詞の意味が重要なクエリでも、検索エンジンが文脈を正しく理解できるようになりました。SEO実務への影響としては、キーワードの機械的な詰め込みではなく、ユーザーが実際に使う自然な表現でコンテンツを書くことの重要性が高まった点が挙げられます。

ユーザビリティ

ユーザビリティとは、サイトやページの使いやすさを指します。

情報が見つけやすい、読みやすい、次に何をすればよいか分かる、といった状態が整っているほどユーザビリティは高いと言えます。SEOでは、検索意図に合う情報提供だけでなく、ページ体験の良さも無視できません。

国際標準化機構(ISO 9241-11)では、ユーザビリティを「特定のユーザーが、特定の状況で、効果的・効率的・満足して目標を達成できる度合い」と定義しています。SEOとの関係では、ユーザビリティの低いページは直帰率が高くなりやすく、結果的に検索エンジンからの評価にも影響しえます。ヒートマップツールやユーザーテストで課題を可視化すると、改善の優先度が明確になります。

リダイレクト

リダイレクトとは、あるURLにアクセスしたユーザーやクローラーを、別のURLへ自動転送する仕組みです。

主にURL変更、ページ統合、サイト移転時に使われます。古いURLの評価や流入を新URLへ引き継ぐためにも重要で、設定漏れがあると、せっかく積み上げた評価や導線を失いやすくなります。

主な種類として、恒久的な移転を示す301リダイレクトと、一時的な移転を示す302リダイレクトがあります。リダイレクトチェーン(複数回の転送)が多すぎると、クローラーの巡回効率が下がり、ページ表示速度にも影響するため注意が必要です。サイトリニューアル時には、旧URLと新URLの対応表を事前に作成し、リダイレクト設定漏れがないか確認することが実務の基本です。

ローカルSEO

ローカルSEOとは、地域に関連する検索で店舗や施設の情報を見つけてもらいやすくする施策で、日本ではMEOと呼ばれることも多いです。

「渋谷 ランチ」「新宿 歯医者」のように地域性が強い検索では、通常の自然検索だけでなく地図や店舗情報の表示が重要になります。Googleビジネスプロフィールの整備、口コミ、営業時間の正確性などが成果に直結しやすい分野です。

具体的な施策としては、Googleビジネスプロフィールの最適化、口コミへの返信、NAP情報(Name・Address・Phone)の各サイトでの統一、ローカルコンテンツの充実などがあります。「近くの○○」「○○ 駅名」といった検索が増加しており、特にスマートフォンからの検索では地図結果が上位表示されやすい傾向があります。

CTR(Click Through Rate)

CTRとは、検索結果やWeb広告が表示された回数に対して、実際にクリックされた割合を示す指標です。

SEOでは主に「検索結果でのクリック率」を指します。タイトルやディスクリプションの内容、検索順位、リッチリザルトの有無などが影響します。順位が高くてもCTRが低い場合は、タイトルの訴求力を見直す余地があるかもしれません。

計算式は「クリック数÷表示回数×100」です。Google Search Consoleで確認できます。

一般的に検索順位1位のCTRは20〜30%程度とされますが、クエリの種類やSERPの構成によって大きく変動します。CTR改善の施策としては、タイトルへの具体的な数字やベネフィットの追加、メタディスクリプションの最適化、構造化データによるリッチリザルトの獲得などが有効です。

CVR(Conversion Rate / コンバージョン率)

CVRとは、Webサイトに訪問したユーザーのうち、問い合わせや購入などの成果(コンバージョン)に至った割合です。

計算式は「コンバージョン数÷セッション数(または訪問数)×100」です。SEOでは流入を増やすことに注目しがちですが、CVRが低いままではビジネス成果につながりません。

CVRの改善には、ページの導線設計、CTAの配置、フォームの使いやすさ、コンテンツと検索意図のマッチ度などが関わります。

業界やサイト種別によってCVRの平均値は大きく異なり、ECサイトで1〜3%、BtoBの問い合わせで2〜5%程度が一般的な目安です。CVRを改善するには、検索意図とコンテンツの一致度、フォームの使いやすさ、CTAの訴求力、ページ表示速度など複数の要素を総合的に見直す必要があります。

SEM(Search Engine Marketing)

SEMとは、検索エンジンを活用したマーケティング全般を指す用語で、SEOとリスティング広告の両方を包含する概念です���

日本ではSEMという言葉がリスティング広告(検索連動型広告)のみを指して使われることもありますが、本来の意味はSEOも含む上位概念です。

自然検索と有料検索のどちらに注力するかは、商材の特性、予算、競合状況などで変わります。短期的な集客にはリスティング広告、中長期的な資産形���にはSEOという使い分けが一��的です。

SEMの戦略設計では、SEOとリスティング広告それぞれの強みを活かした使い分けが重要です。例えば、CVに直結するキーワードは広告で確実に表示させつつ、情報収集段階のキーワードはSEOでコンテンツ資産として積み上げるアプローチが効果的です。

MEO(Map Engine Optimization)

MEOとは、Googleマップの検索結果(ローカルパック)で自社の店舗や拠点を上位に表示させるための施策です。

「ローカルSEO」とほぼ同義ですが、日本では特にGoogleビジネスプロフィール(旧Googleマイビジネス)の最適化を指してMEOと呼ばれることが多いです。

飲食店、クリニック、美容室など、地域に根ざしたビジネスではSEOと並んで重要な集客手段です。口コミの管理、NAP情報(名称・住所・電話番号)の一貫性、写真の充実などが主な施策です。

MEOの効果を高めるには、口コミの数と質が特に重要です。来店後のお客様にレビューを依頼する仕組みを整えつつ、ネガティブな口コミにも丁寧に返信することで、信頼性の向上とGoogleマップでの上位表示の両方が期待できます。

PAA(People Also Ask)

PAAとは「他の人はこちらも質問」として検索結果に表示される関連質問のセクションで、People Also Askの略です。

Googleが検索クエリに関連する質問と回答をアコーディオン形式で表示する機能です。質問をクリックすると回答が展開され、さらに関連する質問が追加されます。

SEO実務では、PAAに表示される質問を把握することで、ユーザーが求める情報の幅を理解し、コンテンツ設計に活かすことができます。構造化データやFAQの整備がPAA表示につながる場合もあります。

PAAに表示される質問は、ユーザーが求めている追加情報を把握する手がかりになります。コンテンツ制作では、PAAの質問を見出しやFAQセクションに取り入れることで、検索意図を幅広くカバーしやすくなります。

Webマーケティング

Webマーケティングとは、Webサイトやインターネットを活用して集客・販促・ブランディングを行うマーケティング手法の総称です。

SEO、リスティング広告、SNSマーケティング、コンテンツマーケティング、メールマーケティングなど、多様な手法が含まれます。

デジタルマーケティングとの違いは厳密に定義されているわけではありませんが、Webマーケティングは主にWebサイトを起点とした施策を指すことが多いです。SEOはWebマーケティングの中核的な手法の一つです。

SEOはWebマーケティングの中でも中長期的な資産形成に適した手法です。施策の選択では、ターゲット顧客の行動パターン、予算、成果が出るまでのスピード感などを総合的に判断し、SEO・広告・SNSなどを組み合わせた統合的なアプローチが効果的です。

コンテンツマーケティング

コンテンツマーケティングとは、ユーザーにとって価値ある情報(コンテンツ)を提供し、見込み顧客の獲得・育成・ファン化を図るマーケティング手法です。

ブログ記事、ホワイトペーパー、動画、メルマガなど形式は多岐にわたります。SEOとの関係では、検索ニーズに応えるコンテンツを作成し、自然検索からの流入を獲得する「コンテンツSEO」が代表的な接点です。

広告と異なり即効性は低いですが、蓄積されたコンテンツが継続的な集客資産になる点が大きなメリットです。

成功のポイントは、ターゲット読者のペルソナを明確にし、各購買段階に対応したコンテンツを計画的に制作することです。効果測定では、PV数だけでなく、リード獲得数やCVへの貢献度まで追跡できる仕組みを構築することが重要です。

オウンドメディ���

���ウンドメディアとは、企業が自社で保有・運営するメディアの総称です。広義にはコーポレートサイト全体、狭義には自社ブログやWebマガジンを指します。

「ペイドメディア(広告)」「アーンドメディア(SNSや口コミ)」と合わせて「トリプルメディア」と呼ばれるフレームワークの一角です。

SEO文脈では、自社メディアにコンテンツを蓄積し、検索流入を安定的に獲得する戦略の基盤として語られます。運営には継続的なコンテンツ制作体制と、明確な目的設計が不可欠です。

オウンドメディアの運営で成果を出すには、「誰に・何を・どの段階で届けるか」を明確にしたうえで、SEO記事、事例紹介、ホワイトペーパーなどコンテンツの種類を使い分けることが重要です。運営体制の構築(編集フロー、品質基準、更新頻度)を初期段階で設計しておくと、安定したコンテンツ供給が可能になります。

カスタマ��ジャーニー

カスタマージャーニーとは、顧客が商品やサービスを認知してから購入・継続利用に至るまでの一連の体験プロセスを可視化したものです���

認知→興味→比較検討→購入→継続利用というフェーズごとに、ユーザーの行動・感情・接点(タッチポイント)を整理します。

SEOではカスタマージャーニーの各段階に対応するキーワードとコンテンツを設計することで、検索ニーズの全体像をカバーできます。たとえば認知段階では「〇〇とは」系、比較検討段階では「〇〇 比較」「〇〇 おすすめ」系のキーワードが対応します。

カスタマージャーニーマップを作成する際は、実際の顧客データやインタビューに基づいて作ることが重要で、想像だけで作ると実態との乖離が大きくなりやすいです。SEOとの連携では、各段階の検索キーワードをマッピングすることで、コンテンツ戦略の全体設計がしやすくなります。

セマンティック検索

セマンティック検索とは、検索キーワードを単なる文字列ではなく「意味」と「検索意図」で理解し、ユーザーが知りたい内容に近い結果を返す検索の仕組みです。

文字列の一致だけで判定していた時代は、キーワードを詰め込んだページが評価されることもありました。現在はGoogleが検索クエリの意味と文脈を理解するようになり、その検索で何を達成したいかに近いページが上位に来るようになっています。

この流れを支えてきたのが、ハミングバードアップデート(2013)による「質問全体の意味理解」、RankBrain(2015)による機械学習ベースの曖昧クエリ対応、BERT(2019)による自然言語処理での前後関係理解、そしてMUM・AI Overviewへと続く意味理解の進化です。SEO実務では、キーワードを何回入れるかより、その検索で必要な答えを過不足なく揃えているかが基本動作になります。

コアアップデート

コアアップデートとは、Googleが年に数回実施する、検索アルゴリズム全体の大規模なアップデートのことです。

特定の手法を狙い撃ちするのではなく、検索結果の品質全体を見直す目的で行われます。コアアップデートのたびに順位が大きく動くため、SEO担当者は実施タイミングと変動内容のチェックが欠かせません。

回復のための「特効薬」はなく、コンテンツの質、専門性、ユーザー体験を継続的に高めることが基本対策です。順位が下がった場合も、慌てて記事をリライトするより、まずは検索意図とのズレや情報の網羅性、独自性を点検するのが効きます。

サイトに関するSEO用語

サイト構造やHTML、URL設計に関する用語は、SEOの土台そのものです。記事内容が良くても、サイト側の設計が曖昧だと評価が分散しやすくなります。

アンカーテキスト

アンカーテキストとは、リンクとして表示される文字列のことです。

リンク先の内容が分かる文言にすると、ユーザーにも検索エンジンにも意図が伝わりやすくなります。「こちら」だけのリンクより、「SEOの基本を解説したページ」のように内容が分かる表現のほうが有効です。

⇒アンカーテキストについては、アンカーテキストとは?SEOへの影響や正しい設置方法、注意点についても参考にしてみてください。

実務では、過度に最適化されたアンカーテキスト(完全一致キーワードの繰り返し)はGoogleからの不自然なリンクパターンとして検出されるリスクがあります。自然なアンカーテキストの分布として、ブランド名、URL、キーワード系、一般的な表現などがバランスよく混在している状態が理想的です。

AMP

AMP(Accelerated Mobile Pages)とは、モバイルページを高速表示するための仕組みとして使われてきた技術です。

以前はニュース系サイトを中心に導入が進みましたが、2026年時点では「AMPだから有利」という考え方ではなく、通常ページでも十分な表示速度と使いやすさを確保することが重視されています。新規導入を検討する際は、保守性や実装負荷も含めて判断すると良いでしょう。

AMPの導入を判断する際は、通常ページのCore Web Vitals(LCP・INP・CLS)をまず計測し、十分な速度が出ているなら無理にAMP化する必要はありません。ニュースサイトなど一部の用途では依然として有用ですが、実装・保守のコストを考慮して総合的に判断することが大切です。

H1

H1は、ページ全体の主題を示す最上位の見出しタグです。

コンテンツのテーマを明確に伝える役割があり、通常は1ページに1つが分かりやすい設計です。H1とタイトルの文言は完全一致でなくても構いませんが、内容の軸は揃えておく必要があります。

H1タグの内容はページタイトル(title要素)と完全一致させる必要はありませんが、テーマの軸は揃えるべきです。CMSによってはH1が自動生成される場合があるため、意図した内容が出力されているかテンプレート側も確認しましょう。H1に主要キーワードを自然な形で含めることは、検索エンジンへのテーマ伝達として基本的な施策です。

SSL化

SSL化とは、Webサイトとユーザー間の通信を暗号化し、HTTPSで安全にやり取りできるようにすることです。

第三者による盗聴や改ざんのリスクを下げるだけでなく、現在のWeb運用ではほぼ前提条件です。SEO以前に、ユーザーの信頼を損なわないための基本対応と考えるのが自然です。

SSL化していないHTTPサイトでは、ブラウザのアドレスバーに「保護されていない通信」と表示され、ユーザーの離脱につながりやすくなります。SSL化の際には、HTTP→HTTPSへの301リダイレクト設定、内部リンクのURLスキーム統一、Google Search Consoleへの再登録、サイトマップの更新などが必要です。無料のSSL証明書(Let's Encrypt等)を利用すればコストを抑えて導入できます。

altタグ(オルトタグ)

altタグとは、画像の内容をテキストで説明するための属性で、代替テキストとも呼ばれます。

画像が表示されない環境やスクリーンリーダー利用時にも役立ち、検索エンジンが画像内容を理解する手がかりにもなります。装飾画像に無理に説明を入れる必要はありませんが、内容理解に必要な画像には具体的な説明を付けることが大切です。

実務でのalt属性の書き方としては、「写真」「画像」などの冗長な表現を避け、画像に写っている内容を簡潔に記述することが推奨されます。例えば「グラフ」ではなく「2025年の検索エンジンシェア推移グラフ」のように具体的に書くと、画像検索からの流入やアクセシビリティの向上にもつながります。

canonicalタグ(カノニカル)

canonicalタグとは、内容が重複または類似する複数URLの中で、どれを正規URLとして評価してほしいかを検索エンジンに伝えるための指定です。

ECで色違い商品ページが複数ある、並び替えURLが量産される、計測パラメータ付きURLが増える、といった場面で重要になります。評価を集約したいURLを明確にしないと、順位が伸びない原因になることがあります。

実装時の注意点として、canonicalタグは「ヒント」であり「命令」ではないため、Googleが必ず従うとは限りません。ページ内容が大きく異なるURLにcanonicalを設定すると無視される可能性があります。また、自己参照canonical(そのページ自身を正規URLとして指定)は、意図しない重複を防ぐベストプラクティスとして推奨されています。

強調スニペット

強調スニペットとは、検索結果の上部で、質問への答えとしてページの一部が抜粋表示される枠のことです。

定義、手順、比較、一覧など、答えが明確なクエリで表示されやすい傾向があります。見出し直下で結論を簡潔に言い切る構成は、強調スニペットを狙ううえでも有効です。

強調スニペットの主な形式には、段落型、リスト型、テーブル型があります。段落型を狙う場合は、見出し直下に40〜60文字程度で明確に回答を記述するのが効果的です。強調スニペットに採用されると、検索結果の最上部(いわゆるポジションゼロ)に表示されるため、CTR向上が期待できます。

グローバルナビゲーション

グローバルナビゲーションとは、サイト全体で共通表示される主要メニューのことです。

主要カテゴリや重要ページへの導線を整理することで、ユーザーがサイト構造を把握しやすくなり、回遊性も高まります。SEOの観点でも、重要ページへ内部リンクを集める役割があります。

実務では、主要カテゴリを5〜7項目程度に絞り、ユーザーが迷わずに目的のページへ遷移できるよう設計します。スマートフォンではハンバーガーメニュー内に収納されることが多いため、タップしやすいサイズや表示順序にも配慮が必要です。SEOの観点では、グローバルナビゲーションは全ページから内部リンクが集まる導線になるため、重要ページへの評価集約に役立ちます。

構造化データ

構造化データとは、ページ内容を検索エンジンが機械的に理解しやすい形式で記述するデータです。

FAQ、レビュー、商品、記事、組織情報など、ページの種類に応じたマークアップを行うことで、検索結果での見え方が改善する可能性があります。ただし、設定できるから入れるのではなく、そのページ形式に本当に合っているかを先に確認することが重要です。

主な記述形式はJSON-LDで、Googleもこの形式を推奨しています。Schema.orgで定義されたタイプ(Article、FAQPage、Product、BreadcrumbListなど)から、ページの種類に合ったものを選んで実装します。Googleのリッチリザルトテストツールで事前に検証してから公開すると、エラーを防ぎやすくなります。

サイトマップ

サイトマップとは、サイト内のページ一覧を整理して伝える仕組みで、HTMLサイトマップとXMLサイトマップがあります。

HTMLサイトマップはユーザー向け、XMLサイトマップは検索エンジン向けです。特にXMLサイトマップは、重要ページを見つけてもらいやすくする補助として有効です。ページ数が多いサイトや更新頻度が高いサイトでは、整備しておく価値があります。

⇒XMLサイトマップを整理したい場合は、XMLサイトマップ(sitemap.xml)とは?SEO効果や作成、設置方法も是非参照ください。

実務では、XMLサイトマップは更新頻度の高いページや新規追加ページを検索エンジンに効率的に発見してもらうための補助手段として位置づけられます。WordPressでは、Yoast SEOやRank Mathプラグインが自動でXMLサイトマップを生成してくれるため、手動管理の負担は少なくなっています。

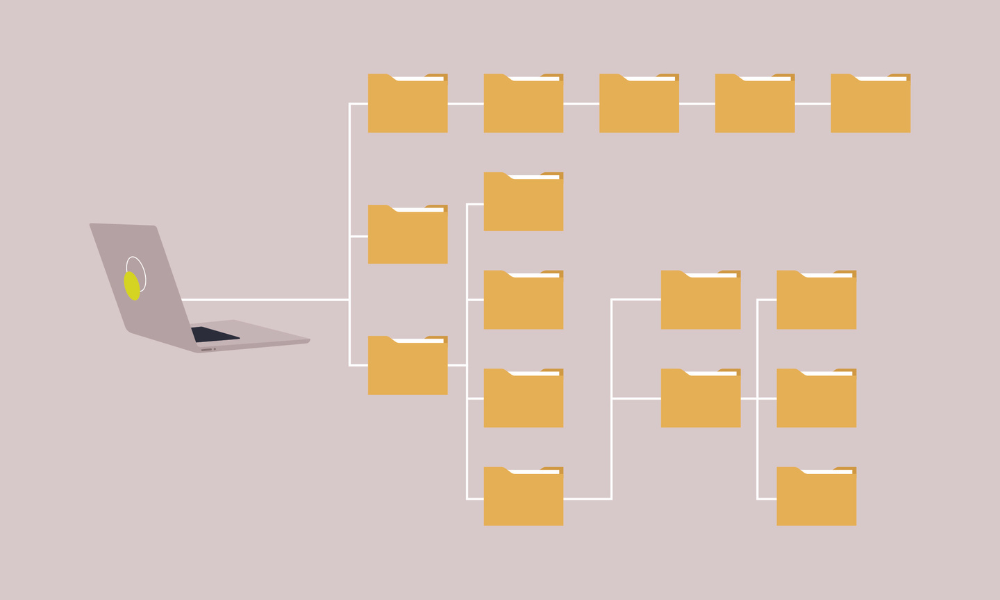

サブディレクトリ

サブディレクトリとは、メインドメイン配下の階層を分けるフォルダ構造のことです。

わかりやすくパソコンに置き換えて考えると、デスクトップが「メインドメイン」に相当し、デスクトップ内のフォルダが「サブディレクトリ」に該当します。

SEOでは、同一テーマのコンテンツをサブディレクトリにまとめることで、メインドメインの評価をそのまま活用しやすいメリットがあります。ブログやコラムをサブディレクトリ(例:example.com/blog/)で運営するのは一般的なパターンで、ドメイン全体のテーマ関連性を維持しやすい構成です。

サブドメイン

サブドメインとは、メインドメインの前に任意の文字列を付けて分ける別領域のことです。

ブログ、サポートサイト、採用サイトなど、テーマや運用体制が異なる場合に使われます。サブディレクトリとどちらが良いかは一概に決まらず、目的、運用体制、ブランド設計で判断するのが実務的です。

サブドメインで運営した場合、検索エンジンはメインドメインとある程度関連付けて評価しますが、完全に同一サイトとは扱わない場合があります。そのため、SEO評価をメインサイトに集中させたい場合はサブディレクトリの方が有利になることが多いです。一方、テーマが大きく異なるサービスや多言語サイトではサブドメインの方が管理しやすい場合があります。

301リダイレクト

301リダイレクトとは、URLの恒久的な移転を示す転送処理です。

サイト移転、URL変更、ページ統合の際に使われ、旧URLの評価を新URLへ引き継ぐ基本手段になります。SEOでは最もよく使うリダイレクトの一つです。

301リダイレクトを設定すると、旧URLが持っていた被リンク評価の大部分が新URLに引き継がれます。設定方法はサーバー環境によって異なり、Apacheなら.htaccess、Nginxならnginx.conf、WordPressならプラグインやfunctions.phpで対応するのが一般的です。設定後はGoogle Search Consoleでインデックス状況を確認し、旧URLからの移行が正しく進んでいるか検証しましょう。

302リダイレクト

302リダイレクトとは、URLの一時的な移転を示す転送処理です。

分かりやすい302リダイレクトの使用例にはABテストやサイトメンテナンスなどが挙げられます。

恒久移転ではない場面で使うのが基本です。301と302を逆に使うと、評価の引き継ぎやインデックスの扱いが意図とずれることがあるため、目的に応じて選び分けましょう。

SEO上、301と302の使い分けは重要です。恒久移転に302を使うと、検索エンジンが旧URLを正規URLとして扱い続ける可能性があり、新URLへの評価移行が遅れることがあります。逆に、ABテストやメンテナンス中の一時的な転送に301を使うと、テスト終了後に戻しにくくなるため注意が必要です。

CSS

CSS(Cascading Style Sheets)とは、Webページの見た目やレイアウトを指定するための言語です。

HTMLで構造を作り、CSSでデザインを整えるのが基本です。SEOでは直接の順位要因というより、読みやすさやモバイル表示、隠しテキストの誤実装防止などに関わります。

表示速度の観点では、未使用CSSの削除やCSSファイルの圧縮(minify)がCore Web Vitals改善に寄与します。クリティカルCSSをインラインで配置し、残りを非同期で読み込む手法はLCP改善のベストプラクティスの一つです。また、CSSでdisplay:noneを使って重要コンテンツを隠す実装は、隠しテキストと判断されるリスクがあるため注意しましょう。

タイトル

タイトル(ページタイトル)とは、ページ内容を端的に表すテキストで、検索結果でも大きく表示される重要要素です。

ユーザーがクリックするかどうかを左右するだけでなく、検索エンジンがページテーマを理解する手がかりにもなります。狙うキーワードを入れつつ、内容とずれない自然な文言にすることが重要です。

実務でのタイトル設計では、主要キーワードを前方(左側)に置く、30〜35文字程度に収める、ページ固有の内容が分かる文言にする、といった基本ルールがあります。Googleがタイトルを書き換えて表示するケースも増えているため、title要素だけでなくH1や本文との一貫性も意識すると、意図通りの表示を維持しやすくなります。

ディスクリプション

ディスクリプションとは、ページ内容を要約する説明文で、検索結果のタイトル下に表示されることがある要素です。

メタディスクリプションとして設定できますが、検索語句やページ内容に応じて別の文が表示されることもあります。それでも、ページ全体を簡潔に要約しておくことで、クリック前の理解を助けやすくなります。

メタディスクリプションの推奨文字数は120文字前後(モバイル表示)が目安です。検索キーワードとの関連性が高い文言は太字で表示されるため、主要キーワードを自然に含めると視認性が高まります。ディスクリプションを設定しなくてもGoogleが自動生成しますが、意図通りの訴求を行うために手動設定を推奨します。

ドメイン

ドメインとは、インターネット上でWebサイトの所在を示す住所のようなものです。

任意の文字列を選べますが、すでに使われているものは取得できません。末尾の「.com」「.jp」「.co.jp」などはトップレベルドメインや属性型JPドメインとして分類されます。

新規ドメイン取得時には、過去にスパムサイトで使われていた中古ドメインを避けるため、Wayback Machineやwhois履歴で過去の利用状況を確認することが推奨されます。SEOへの直接的な影響としては、ドメイン名そのものよりも、そのドメインで運営されるコンテンツの質と被リンクの蓄積が重要です。

noindex

noindexとは、検索エンジンにそのページをインデックスさせないよう伝えるための指定です。

会員限定ページ、重複しやすい絞り込みページ、内容が薄い一時ページなど、検索結果に出す必要がないURLで使われます。重要なのは「出したくないから全部noindex」ではなく、評価を集めたいURLを明確にしたうえで使うことです。

設定方法はmetaタグによる指定()が一般的です。robots.txtでクロールをブロックしてもインデックスは防げない点に注意が必要です。サイト全体をnoindex状態にしたままCMSのステージング環境を公開してしまうミスは実務でよくあるため、本番反映前にrobots設定を必ず確認しましょう。

nofollow

nofollowとは、リンク先との関係性を検索エンジンに伝えるrel属性の一つです。

以前のように「必ずリンクをたどらせない命令」と理解するより、現在はリンクの扱いに関するヒントとして捉えるのが適切です。広告リンクならsponsored、UGCならugcなど、より意味に合った属性を使い分けることも重要です。

⇒nofollowの考え方は、nofollow属性とは?SEOにおける役割や設定方法について解説で整理しています。

2019年以降、Googleはnofollowを「命令」ではなく「ヒント」として扱うよう変更しました。広告リンクにはrel="sponsored"、ユーザー投稿コンテンツのリンクにはrel="ugc"を使い分けるのが現在の推奨です。自社サイト内の内部リンクにnofollowを付けてPageRankの流れを制御する「PageRankスカルプティング」は、現在ではほぼ意味がないとされています。

パーマリンク

パーマリンクとは、各ページに割り当てられるURLのうち、ドメイン以下の固有部分を指します。

例えば、https://emma.tools/magazine/ の場合、/magazine/ がパーマリンクにあたります。

短く、意味が分かりやすく、英数字とハイフン中心で設計するのが基本です。公開後に変更するとリダイレクト対応が必要になるため、最初の設計が重要です。

理想的なパーマリンクは、短く、意味が分かりやすく、英単語をハイフンで区切った形式です。日本語URLは見た目に分かりやすい反面、SNSやメール共有時にエンコードされて長い文字列になるデメリットがあります。WordPressの場合、パーマリンク設定で「投稿名」ベースにするのがSEO的に推奨されるパターンです。

パンくずリスト

パンくずリストとは、ユーザーがサイト内のどの階層にいるかを示すナビゲーションです。

位置型、属性型、パス型などがありますが、一般的なWebサイトでは階層位置を示す形式がよく使われます。ユーザーの現在地を分かりやすくするだけでなく、内部リンク構造の補助にもなります。

SEO実務では、パンくずリストに構造化データ(BreadcrumbList)を合わせて実装すると、検索結果にパンくずが表示され、ユーザーのクリック判断を助けやすくなります。WordPressの場合、Yoast SEOやRank Mathなどのプラグインで構造化データ付きパンくずを簡単に実装できます。

ファビコン

ファビコンとは、ブラウザのタブやブックマーク、スマートフォンのショートカットなどに表示されるサイトのアイコンです。

インターネットブラウザのタブやアドレスバー、スマートフォンやタブレットのトップ画面にサイトへのショートカットを設置した場合に表示されるアイコンが該当します。

当サイトの場合、EmmaToolsの「E」をモチーフにした、以下の画像になります。

![]()

Google検索のモバイル結果にもファビコンが表示されるため、ブランド認知やクリック率に間接的な影響を与えます。推奨サイズは48px×48pxの倍数で、32×32や64×64が一般的です。SVG形式に対応するブラウザも増えており、高解像度ディスプレイでもきれいに表示できるメリットがあります。

URLの正規化

URLの正規化とは、同じ内容に到達できる複数URLがある場合に、評価対象となるURLを1つに揃えることです。

例として、wwwの有無、末尾スラッシュ違い、httpとhttpsの混在、ECで色違い商品ページが複数あるケースなどが挙げられます。

順位が伸びないサイトでは、コンテンツ不足より「どのURLを評価してほしいかが曖昧」な状態が原因になっていることがあります。細かなズレでも積み重なると評価分散につながるため、地味ですが重要な整備です。

正規化の主な手段には、301リダイレクト、canonicalタグの設定、サイトマップへの正規URLのみの掲載、内部リンクの統一などがあります。複数の手段を組み合わせて一貫した正規化を行うことで、検索エンジンが迷わず正しいURLを評価できるようになります。ECサイトやパラメータ付きURLが多いサイトでは、特に優先的に取り組むべき施策です。

リッチリザルト

リッチリザルトとは、通常のタイトルと説明文に加えて、レビュー、FAQ、商品情報などが検索結果に追加表示される形式の総称です。

検索結果での視認性が高まり、クリック率改善につながることがあります。ただし、構造化データを入れれば必ず表示されるわけではなく、ページ内容とマークアップの整合性が前提です。

代表的なリッチリザルトの種類には、FAQ、レビュー(星評価)、レシピ、イベント、商品、How To、パンくずリストなどがあります。すべての種類を一度に実装するのではなく、自社のページタイプに合ったものから優先的に対応するのが実務的です。Google Search Consoleの「拡張」セクションで、実装済みの構造化データのエラーや有効状況を確認できます。

レスポンシブ

レスポンシブとは、PC・スマートフォン・タブレットなど画面サイズの異なる端末に応じて、同じURLのページ表示を最適化する設計です。

更新管理を一元化しやすく、モバイル対応の基本形として広く採用されています。別URL運用より保守しやすいため、更新頻度が高いサイトほど相性が良いです。

レスポンシブデザインの実装では、CSSのメディアクエリを使って画面幅に応じた表示切り替えを行います。注意点として、画像の最適化(srcset属性の活用)やタップターゲットのサイズ確保(48px以上)などもあわせて対応することで、Core Web Vitalsの改善にもつながります。

robots.txt

robots.txtとは、クローラーに対して、どのURL群をクロール対象にするかを伝えるためのファイルです。

ただし、robots.txtはクロール制御であり、インデックス除外の万能手段ではありません。検索結果に出したくないページはnoindexで制御するのが基本です。両者を混同すると、意図した制御にならないことがあります。

robots.txtはサイトのルートディレクトリ(例:example.com/robots.txt)に配置します。記述ミスにより重要なページのクロールをブロックしてしまう事故は実務でも起きやすいため、変更前にGoogle Search Consoleのrobots.txtテスターで影響を確認することを推奨します。機密情報の保護手段としてrobots.txtに頼るのは不十分で、認証やアクセス制御と組み合わせる必要があります。

aタグ(アンカータグ���

aタグとは、HTMLでハイパーリンクを作成するためのタグで、テキスト の形式で記述します。

SEOにおいては、aタグのhref属性に指定するURLとアンカーテキスト(リンクテキスト)の両方が重要です。適切なアンカーテキストは、リンク先の内容をユーザーと検索エンジンの双方に伝える役割を果たします。

target="_blank"で別タブを開く設定や、rel="nofollow"でリンク評価の受け渡しを制御する設定など、SEOに影響する属性も複数あります。

SEO実務では、aタグにrel属性(nofollow、sponsored、ugc)を適切に設定することが重要です。内部リンクのaタグには説明的なアンカーテキストを使い、クローラーがリンク先の内容を正しく把握できるようにすることが基本的な対策です。

hタグ(見出しタグ)

hタグとは、HTMLで見出しを定義するタグで、h1からh6までの6段階があります。数字が小さいほど上位の見出しです。

h1はページ全体の大見出し(通常はページタイトル)、h2は大きなセクション、h3はh2内の小見出しといった階層構造で使います。SEOでは、見出しタグに適切なキーワードを含めつつ、論理的な階層構造を保つことが重要です。

h1を複数使うこと自体はHTML5の仕様上問題ありませんが、SEOの実務では1ページ1つのh1が推奨されます。見出しの順序を飛ばす(h2の直後にh4を使うなど)のも避けたほうが無難です。

meta refresh(メタリフレッシュ)

meta refreshとは、HTMLのmetaタグを使って一定時間後にページを自動的にリダイレクトまたは更新する仕組みです。

サーバー設定を変更せずにリダイレクトを設定できる手軽さがありますが、SEOの観点からは推奨されません。Googleは301リダイレクトや302リダイレクトの使用を推奨しており、meta refreshによるリダイレクトではPageRankの受け渡しが不完全になる可能性があります。

やむを得ず使用する場合でも、遅延時間を0秒に設定し、即時リダイレクトとして使うのが実務上の最低ラインです。

ページネーション

ページネーションとは、長いコンテンツや大量の一覧情報を複数ページに分割して表示する仕組みです。

ECサイトの商品一覧や、記事一覧ページなどで「1, 2, 3… 次へ」と表示されるナビゲーションが該当します。

SEOでは、分割されたページがそれぞれ別URLになるため、クロール効率やインデックスの管理が課題になります。Googleは以前rel="prev"/rel="next"を推奨していましたが、現在は公式にサポートを終了しています。実務では、重要なコンテンツが深いページに埋もれないよう、1ページあたりの掲載件数や内部リンク設計を工夫することが大切です。

Web��イト

Webサイトとは、インターネット上に公開された、複数のWebページの集合体のことです。

「ホームページ」と混同されることが多いですが、厳密にはホームページはWebサイトのトップページ(最初に表示されるページ)を指します。日本では慣習的に「ホームページ」がWebサイト全体を指して使われることもあります。

SEOではWebサイト全体の構造(ディレクトリ構成、内部リンク、サイトマップ)が検索エンジンの評価に影響します。個別ページの最適化だけでなく、サイト全体の設計を意識することが重要です。

SEOの観点では、Webサイト全体のテーマ性、サイト構造の論理性、ドメイン全体のE-E-A-T(経験・専門性・権威性・信頼性)が個別ページの評価にも影響します。サイト設計の段階で、ディレクトリ構造、内部リンク導線、パンくずリスト、サイトマップなどを整備しておくことが、長期的なSEO成果の基盤になります。

FAQ構造化データ

FAQ構造化データとは、よくある質問(FAQ)の内容をJSON-LD形式でマークアップし、検索エンジンが質問と回答のペアを理解できるようにする仕組みです。

正しく実装すると、検索結果に質問と回答がリッチリザルトとして表示される可能性があります。これにより検索結果での占有面積が増え、CTRの向上が期待できます。

ただし、Googleは2023年以降、一般サイトのFAQリッチリザルト表示を制限しています。政府・医療機関など権威性の高いサイトでは引き続き表示される場合があります。実装自体は検索エンジンの内容理解を助けるため、表示されなくても意味は��ります。

EFO(Entry Form Optimization)

EFOとは、Webサイトの入力フォームを最適化し、ユーザーの離脱を減らしてコンバージョン率を高める施策です。

問い合わせフォーム、会員登録フォーム、購入フォームなどが対象です。入力項目の削減、リアルタイムバリデーション、ステップ表示、自動入力対応などが代表的な改善手法です。

SEOで流入を増やしても、フォームで離脱されてはビジネス成果につながりません。CVR改善施策の中でもEFOは比較的少ない工数で効果が出やすい領域で��。

EFOの改善効果を測定するには、フォームの入力開始率、各フィールドでの離脱率、完了率をステップごとに計測するのが有効です。ヒートマップツールやGA4のイベント計測を活用すると、どの入力項目がボトルネックになっているかを特定しやすくなります。

LPO(Landing Page Optimization)

LPOとは、ランディングページの構成やデザインを最適化し、コンバージョン率を向上させる施策です。

広告や検索から流入したユーザーが最初に見るページ(ランディングページ)の訴求力を高めることで、離脱を防ぎ、目標行動(問い合わせ・購入など)につなげます。

A/Bテスト、ファーストビューの改善、CTAボタンの最適化、ユーザーの不安解消要素(実績・口コミ・保証)の配置などが主な手法です。SEOとの関連では、検索意図に合ったランディングページを用意することが、直帰率の低下と成果向上の両方に効きます。

LPOで成果を出すには、仮説に基づいたA/Bテストを繰り返し、データで改善判断を行うことが鍵です。特にファーストビュー(スクロールせずに見える範囲)の訴求メッセージとCTAの視認性は、CVRに最も影響しやすい要素のため、優先的にテストすべきポイントです。

Webサイト

Webサイトとは、インターネット上に公開された、複数のWebページの集合体のことです。

「ホームページ」と混同されることが多いですが、厳密にはホームページはWebサイトのトップページを指します。日本では慣習的に「ホームページ」がWebサイト全体を指して使われることもあります。

SEOではWebサイト全体の構造(ディレクトリ構成、内部リンク、サイトマップ)が検索エンジンの評価に影響します。個別ページの最適化だけでなく、サイト全体の設計、ドメイン全体のE-E-A-T(経験・専門性・権威性・信頼性)が個別ページの評価にも影響するため、サイト設計の段階で論理的なディレクトリ構造と内部リンク導線を整備することが長期的なSEO成果の基盤になります。

ドメインエイジ

ドメインエイジとは、ドメインが取得されてから現在までの経過年数のことです。

長く運用されているドメインほど信頼性が高いと考えられがちですが、Googleはドメインエイジ自体を直接的なランキング要因として使っていないと公言しています。実際に効くのは、その期間に蓄積された被リンク・コンテンツ・ユーザー体験です。

中古ドメイン(オールドドメイン)購入をSEO目的で行う動きもありますが、Googleはドメインの実質的な運用継続性を見ているため、過去の運用と無関係なテーマで使い始めても、必ずしも有利にはなりません。新規ドメインで長期的に質の高いサイト運営を続けるのが、結果的に最短ルートになります。

キーワードに関するSEO用語

SEOでは、どの言葉で検索されるかを理解しないと、良い記事を書いても届きません。キーワード関連の用語は、流入設計の基礎になります。

関連キーワード

関連キーワードとは、対策したい主キーワードと意味的・文脈的に近いキーワードのことです。

検索結果下部の関連検索や、実際の上位ページで扱われている周辺論点などが参考になります。関連キーワードを押さえることで、ユーザーの疑問を広くカバーしやすくなります。

関連キーワードの調査には、Google検索結果下部の「関連検索」、ラッコキーワード、Ahrefs、Ubersuggestなどのツールが活用できます。関連キーワードを記事構成に組み込む際は、無理にすべてを網羅するのではなく、検索意図に沿った自然な形で本文に含めることが重要です。

共起語

共起語とは、特定のテーマを扱う文脈で一緒に出現しやすい言葉のことです。

例として「SEO」がテーマなら、「検索意図」「内部リンク」「インデックス」などが共起語として現れやすくなります。

共起語は論点漏れの確認には役立ちますが、数を増やせば上がるものではありません。実務では、共起語を満たすことより、他のページより具体的に答えているかのほうが順位差につながりやすいです。

共起語分析ツール(共起語検索、EmmaToolsなど)を使えば、上位ページで頻出するキーワードを効率的に把握できます。ただし、共起語をチェックリスト的に網羅するのではなく、読者の疑問に的確に答えた結果として自然に含まれる状態を目指すのが本質的なアプローチです。

QDF(Query Deserves Freshness)

QDFとは、検索結果で新しさが特に求められるクエリに対して、鮮度の高い情報が重視されやすくなる考え方です。

時事ニュース、制度改正、料金改定、アルゴリズム更新のように、古い情報が役に立ちにくいテーマで影響しやすくなります。一方で、普遍的な基礎知識まで毎回更新日だけ新しくしても評価が上がるわけではありません。

実務では、QDFが影響しやすいテーマ(アルゴリズムアップデート、法改正、年度更新が必要な情報など)の記事は、定期的な更新スケジュールを組んでおくと、鮮度で負けにくくなります。一方で、更新日だけを変えて内容を変えない「偽の更新」は効果がなく、むしろ信頼性を損なうリスクがあります。

QDD(Query Deserves Diversity)

QDDとは、1つの検索語句に対して様々な意図があり、検索結果にも多様なページ形式が並びやすい状態を指します。

例えば「朝食」で検索すると、レシピ、意味、近くの店、健康情報など、複数のニーズが混ざることがあります。

このようなクエリでは、単に上位ページを真似るだけでは不十分で、自社がどの意図を取りに行くかを明確にする必要があります。

QDDが影響するクエリでは、検索結果に異なるタイプのページ(解説記事、動画、EC、ニュース等)が混在して表示されます。対策としては、まずSERPを実際に確認し、どの検索意図が上位に多いかを把握したうえで、自社が狙える意図を明確にし、それに最適化したコンテンツを作ることが効果的です。

検索クエリ

検索クエリとは、ユーザーが検索エンジンに実際に入力した語句のことです。

SEO担当者が狙う「キーワード」と近い意味で使われますが、厳密には、検索クエリはユーザー側の入力、キーワードは施策側の対象語句として区別すると整理しやすいです。

Google Search Consoleの「検索パフォーマンス」レポートで、実際にどの検索クエリで自社ページが表示されているかを確認できます。想定していなかったクエリからの流入を発見することで、新たなコンテンツ制作やリライトのヒントを得られます。クエリの種類は大きく、ナビゲーショナル(特定サイトを探す)、インフォメーショナル(情報を調べる)、トランザクショナル(購入・申込みなどの行動)に分類されます。

検索ボリューム(月間検索数)

検索ボリュームとは、特定のキーワードが一定期間内にどれくらい検索されているかを示す目安です。

ボリュームが大きいほど流入余地はありますが、競合も強くなりやすいです。数値だけでなく、検索意図やCVとの距離も見て優先順位を決めることが重要です。

検索ボリュームの確認には、Googleキーワードプランナー、Ahrefs、Ubersuggestなどのツールが使われます。ボリュームだけを基準にキーワードを選ぶと、競合が強すぎて上位表示が困難な場合があります。検索ボリューム×CTR×CVRの概算で見込みのあるキーワードから着手するのが、成果につながりやすいアプローチです。

ビッグキーワード

ビッグキーワードとは、一般に検索ボリュームが大きく、意味の幅も広いキーワードを指します。

「SEO」「転職」「クレジットカード」のように競合が強く、検索意図も広いため、上位表示の難易度は高めです。定義の数値基準はツールや現場によって異なるため、10,000回以上と固定的に考えるより、相対的な大きさで捉えるほうが実務的です。

実務では、ビッグキーワードを最終的な目標として設定しつつ、まずはロングテールキーワードやミドルキーワードで実績を積み、サイト全体のテーマ性と評価を高めていく戦略が一般的です。ビッグキーワードの検索意図は広く曖昧になりやすいため、ピラーコンテンツとして包括的な記事を設計するのが効果的です。

ブランドキーワード

ブランドキーワードとは、社名、商品名、サービス名など、特定ブランドを含む検索語句のことです。

比較検討が進んだユーザーが検索しやすく、CVに近い傾向があります。ブランド認知が高まるほど指名検索も増えやすくなるため、SEOだけでなく広報やSNS施策とも関係します。

実務では、Google Search Consoleでブランドキーワードの検索回数推移を定期的にモニタリングし、認知度の変化を定量的に把握することが推奨されます。ブランドキーワードで検索した際に、自社の公式ページが1位に表示されないケースもあるため、公式サイトの最適化とサイテーション管理を怠らないことが大切です。

ミドルキーワード

ミドルキーワードとは、ビッグキーワードほど広すぎず、ロングテールほど細かすぎない中間的なキーワードです。

検索意図がある程度具体化されており、流入とCVのバランスを取りやすいのが特徴です。数値基準は固定ではありませんが、実務ではこの層が成果の中心になることも多いです。

例として、「SEO」がビッグキーワード、「SEO 内部対策」がミドルキーワード、「SEO 内部対策 チェックリスト 初心者」がロングテールキーワードといった分類になります。ミドルキーワードは競合との差別化がしやすく、一定の検索ボリュームもあるため、サイト成長期に優先的に攻略すべきレンジです。

ロングテールキーワード

ロングテールキーワードとは、検索ボリュームは小さいものの、意図が具体的で競合も比較的絞られやすいキーワードです。

「SEO 用語集」「SaaS SEO対策」のように、ニーズが明確な語句が該当します。流入数は大きくなくても、検索意図に合えば成果につながりやすく、サイト全体の勝ち筋を作る入口になりやすいです。

実務では、ロングテールキーワードは1記事あたりの流入は少なくても、大量の記事を積み上げることでサイト全体のトラフィックを安定させる役割を果たします。検索意図が明確なため、記事内でCVにつなげやすく、BtoBサイトやニッチ市場では特に効果を発揮しやすいです。

コンテンツに関するSEO用語

コンテンツ制作では、記事を書く技術だけでなく、評価される構造や品質基準の理解が欠かせません。ここでは制作実務でよく使う用語を整理します。

アイキャッチ画像

アイキャッチ画像とは、記事やページの冒頭付近で読者の目を引くために設置する画像です。

内容の第一印象を左右し、SNSや一覧ページでの視認性にも関わります。SEOの直接要因ではありませんが、クリック率や読了率に影響することがあります。

実務では、OGP(Open Graph Protocol)画像としても使われるため、SNSでシェアされた際の視認性にも影響します。推奨サイズは1200×630px程度で、文字を入れる場合は画像内に収まるよう配慮が必要です。アイキャッチ画像のalt属性にも記事テーマに関連するテキストを設定すると、画像検索からの流入が見込める場合があります。

E-E-A-T(旧E-A-T)

E-E-A-Tとは、Experience(経験)、Expertise(専門性)、Authoritativeness(権威性)、Trustworthiness(信頼性)の頭文字を取った考え方です。

特に重要なのは信頼性で、誰が、どのように、なぜその情報を出しているのかが見えることが大切です。YMYL領域ではこの観点がより厳しく見られやすくなります。

当社でも記事改善では、著者情報や監修情報を足すだけでなく、実際の運用経験や一次情報が本文に入っているかまで確認しています。表面上の肩書きだけでは、読者にも検索エンジンにも価値が伝わりにくいためです。

CTA(Call To Action)

CTAとは、ユーザーに次の行動を促すためのボタン、リンク、テキストなどの要素です。

例えば、資料請求、問い合わせ、無料登録、デモ申込みなどのボタンがCTAにあたります。

SEOでは流入後の成果につながる重要要素です。目立てば良いわけではなく、ページ内容と自然につながっていること、クリック後に何が得られるかが分かることが大切です。

効果的なCTAを作るポイントは、ボタンのラベルに具体的なベネフィットを含めること(例:「無料で資料をダウンロード」)、本文の流れに合った位置に配置すること、視覚的に目立つデザインにすることです。記事の途中と末尾の両方にCTAを設置するのが一般的で、ヒートマップで実際のクリック位置を分析して最適化すると効果的です。

コアウェブバイタル

コアウェブバイタルとは、ページ体験を測る主要指標群のことです。

以前はLCP、FID、CLSの3指標で説明されることが多くありましたが、2026年時点ではFIDではなくINPが主要指標として扱われています。つまり、表示速度だけでなく、ユーザー操作への反応の良さも重視される流れです。

2024年3月以降、FID(First Input Delay)に代わりINP(Interaction to Next Paint)が正式指標になりました。LCPは2.5秒以内、INPは200ミリ秒以内、CLSは0.1以下が「良好」の基準です。PageSpeed InsightsやChrome DevToolsで計測でき、改善にはサーバー応答速度、画像最適化、JavaScriptの最適化などが関わります。

構成案

構成案とは、記事制作前に、誰に何をどの順番で伝えるかを整理した設計図です。

タイトル、見出し、論点、必要な事例、CTAの位置まで含めて決めておくと、記事の一貫性が保ちやすくなります。構成が弱いと、文章力があっても検索意図からずれやすくなります。

構成案の作成手順としては、(1)検索意図の分析、(2)競合上位ページの調査、(3)ターゲット読者の設定、(4)見出し構成の設計、(5)各見出しで伝える内容のメモ、という流れが一般的です。構成案の段階で「この記事を読んだ後、読者はどう行動するか」まで設計しておくと、CVにつなげやすい記事になります。

静的なサイト(ページ)

静的なページとは、アクセスする人やタイミングによって表示内容が変わらないページです。

会社概要、サービス紹介、解説記事など、多くのSEOコンテンツはこの形式です。内容が固定されているぶん、検索エンジンにも理解されやすい構造を作りやすい特徴があります。

SEOの観点では、静的ページは表示速度が速く、クローラーがコンテンツを取得しやすいメリットがあります。ただし、コンテンツの更新にはHTMLファイルの直接編集が必要になるため、更新頻度の高いサイトにはCMSの利用が現実的です。Jamstackのような静的サイトジェネレーターを使えば、表示速度と更新性を両立できる場合もあります。

動的なサイト(ページ)

動的なページとは、ユーザー属性や条件、データベースの内容によって表示が変わるページです。

ECの商品一覧、会員ページ、掲示板、検索結果ページなどが代表例です。便利な一方で、URL増殖や重複、クロール制御の難しさが出やすいため、SEOでは設計が重要になります。

SEOでは、動的ページのURLパラメータ(?sort=price&page=2 など)が大量のURLバリエーションを生み、クロールバジェットを浪費したり重複コンテンツが発生する問題に注意が必要です。対策として、不要なパラメータのrobots.txtでのブロック、canonicalタグによる正規化、Google Search Consoleでのパラメータ設定などを組み合わせるのが実務的です。

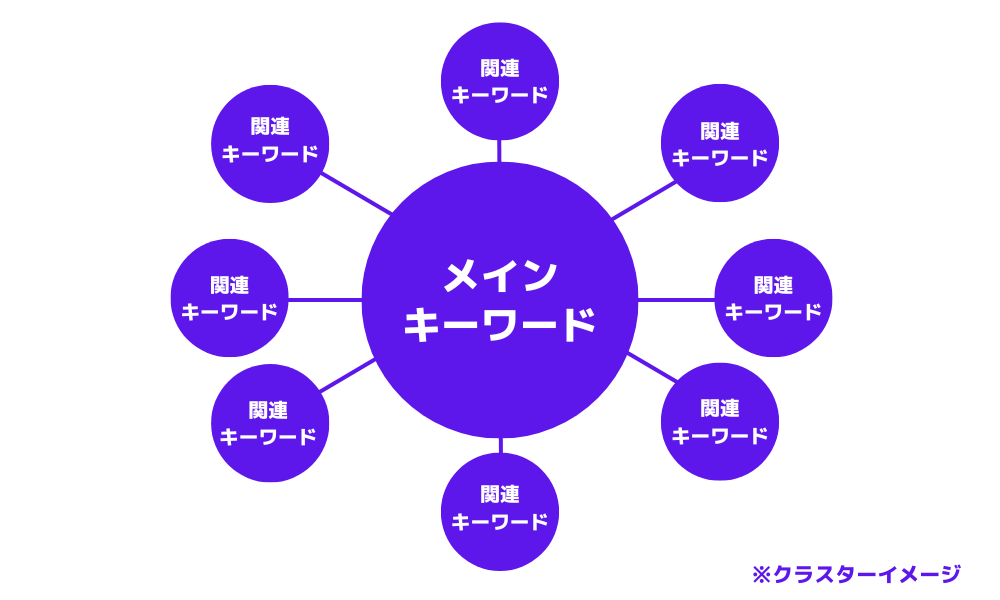

トピッククラスター

トピッククラスターとは、中心となるピラーコンテンツと、その周辺テーマを扱う複数記事を内部リンクでつなぎ、テーマ全体の評価を高める考え方です。

単発記事を増やすより、テーマごとにまとまりを作ることで、ユーザーにも検索エンジンにもサイトの専門性が伝わりやすくなります。

構築の手順としては、(1)軸となるテーマの選定、(2)ピラーコンテンツ(まとめ記事)の作成、(3)クラスター記事(個別テーマ記事)の制作、(4)記事間の内部リンク設計、という流れが一般的です。効果を発揮するには、ピラーとクラスター双方向にリンクを張り、関連性が検索エンジンに伝わるようにすることが重要です。

モバイルファーストインデックス(MFI)

モバイルファーストインデックスとは、モバイル版ページを基準に検索エンジンが内容を評価・理解する考え方です。

2026年時点では特別な新施策というより、モバイル基準が前提になっていると考えたほうが実務に合います。スマホ版だけ比較表が省略されている、重要テキストが読み込まれていない、といった差分は評価にも影響しやすいです。

対応のチェックポイントとして、PC版にはあるがモバイル版では省略されているコンテンツがないか、構造化データがモバイル版にも実装されているか、内部リンクがモバイル版でも機能しているかを確認する必要があります。Google Search Consoleの「モバイルユーザビリティ」レポートで問題のあるページを特定できます。

モバイルフレンドリー

モバイルフレンドリーとは、スマートフォンなどの小さい画面でも、読みやすく操作しやすい状態を指します。

文字サイズ、タップしやすさ、横スクロールの有無、読み込み速度などが関係します。モバイルユーザーが多い領域では、ここが弱いだけで離脱率が大きく変わることがあります。

⇒モバイル対応を見直したい方は、モバイルフレンドリーとは?SEO対策で必要な理由や確認・対応方法もあわせてご覧ください。

具体的なチェック項目として、テキストが拡大なしで読めるか、タップターゲット(ボタンやリンク)が十分な間隔で配置されているか、横スクロールが発生していないか、コンテンツがビューポートに収まっているかなどが挙げられます。Lighthouseの監査結果を参考に、優先度の高い問題から改善していくのが実務的なアプローチです。

UI/UX

UIは見た目や操作画面、UXはそのサイトを使った結果として得られる体験全体を指します。

UIが整っていても、欲しい情報にたどり着けなければUXは良くなりません。SEOでは、検索で来たユーザーが迷わず目的を達成できるかまで含めて考える必要があります。

SEOとの関連では、Core Web Vitals(ページ速度・操作応答性・視覚的安定性)がUXを数値化した指標であり、検索ランキングの評価要素にも含まれています。また、直帰率やページ滞在時間もUXの良し悪しを間接的に示す指標であり、これらが極端に悪い場合は検索順位にも影響する可能性があります。

YMYL

YMYLとは、お金、健康、安全、法律など、人の生活に大きな影響を与えるテーマを指します。

Googleはこうした領域で、情報の正確性や信頼性をより重視します。医療、金融、法律、政治、災害、重要な生活判断に関わるテーマでは、出典、監修、運営者情報まで含めて丁寧に整えることが重要です。

- お金に関する情報サイト(金融や不動産、資産運用など)

- 健康に関する情報サイト(医療や健康維持、ダイエットなど)

- ショッピングサイト(オンラインショッピングサイト・ECサイトなど)

- 法律や政治(弁護士、政治家など)

- 時事問題(ニュース、災害速報など)

- 人権問題(宗教、思想など)

- その他、生活に関わるサイト

LP(ランディングページ)

LP(ランディングページ)とは、ユーザーが最初に到達するページを指します。

ただし、Webマーケティングでは施策によって意味が少し変わります。

| LPの違いについて | |

|---|---|

| 施策 | ランディングページが示すもの |

| SEO(オーガニック検索) | 検索結果画面から最初に訪れたページ |

| 広告 | 広告をクリックした際に表示されるページ |

| SNS(FacebookやXなど) | SNSから最初に訪れたページ |

SEOで重要なのは、検索流入が多いページ(=事実上のランディングページ)を把握し、そのページのファーストビューと導線を最適化することです。Google Analyticsの「ランディングページ」レポートで、各流入経路ごとの入口ページを確認できます。

リード文

リード文とは、本文に入る前に、その記事で何が分かるかを伝える導入文です。

記事の要点、読むメリット、対象読者が短く整理されていると、読者は安心して本文に進めます。SEOでも、冒頭で検索意図に答えているかは重要で、回りくどい前置きは離脱につながりやすくなります。

効果的なリード文の構成としては、(1)読者の課題や疑問を言い当てる、(2)この記事で得られる情報を簡潔に示す、(3)読了後のメリットを伝える、という3要素を含めると離脱を防ぎやすくなります。SEOの観点では、リード文に主要キーワードを自然に含めることも、テーマの明確化に役立ちます。

リライト

SEOにおけるリライトとは、公開済みコンテンツを、検索意図や最新情報に合わせて改善することです。

タイトルや見出し、本文、事例、データ、CTAまで見直し対象になります。単なる言い換えではなく、情報不足や古さを補い、ページの価値を上げる作業です。

アクセス改善では、新規記事作成より先にリライトへ着手したほうが成果につながることがあります。古い記事や情報が薄い記事が残ったままだと、サイト全体の評価にも影響しやすいためです。

効果的なリライトの進め方として、(1)Google Search Consoleで順位が下降傾向のページを特定、(2)検索意図の再分析、(3)競合上位ページとの差分確認、(4)情報の更新と不足部分の追加、(5)公開後のパフォーマンス追跡、という手順が実務では一般的です。

オウンドメディア

オウンドメディアとは、企業が自社で保有・運営するメディアの総称です。広義にはコーポレートサイト全体、狭義には自社ブログやWebマガジンを指します。

「ペイドメディア(広告)」「アーンドメディア(SNSや口コミ)」と合わせて「トリプルメディア」と呼ばれるフレームワークの一角です。

SEO文脈では、自社メディアにコンテンツを蓄積し、検索流入を安定的に獲得する戦略の基盤として語られます。運営には継続的なコンテンツ制作体制と、明確な目的設計が不可欠です。「誰に・何を・どの段階で届けるか」を明確にしたうえで、SEO記事、事例紹介、ホワイトペーパーなどコンテンツの種類を使い分けることが核となります。

カスタマージャーニー

カスタマージャーニーとは、顧客が商品やサービスを認知してから購入・継続利用に至るまでの一連の体験プロセスを可視化したものです。

認知→興味→比較検討→購入→継続利用というフェーズごとに、ユーザーの行動・感情・接点(タッチポイント)を整理します。

SEOではカスタマージャーニーの各段階に対応するキーワードとコンテンツを設計することで、検索ニーズの全体像をカバーできます。認知段階では「〇〇とは」系、比較検討段階では「〇〇 比較」「〇〇 おすすめ」系のキーワードが対応します。実際の顧客データやインタビューに基づいて作ることが重要で、想像だけで作ると実態との乖離が大きくなりやすいです。

リンクに関するSEO用語

リンクは、ユーザーの導線であると同時に、検索エンジンがサイト構造や外部評価を理解する手がかりでもあります。内部・外部の両方を整理して理解しておきましょう。

アウトバウンドリンク

アウトバウンドリンクとは、自社サイトから外部サイトへ向かうリンクのことです。

引用元や参考資料へのリンクとして使われることが多く、適切な出典提示は内容の信頼性を補強します。外部リンク自体を恐れる必要はなく、文脈に合っていれば自然です。

良質なアウトバウンドリンクは、情報の根拠を示す手段として読者の信頼感を高めます。設置の際は、リンク先の信頼性を確認し、アンカーテキストをリンク先の内容が分かる具体的な文言にすることが重要です。外部リンクでページ評価が下がるという懸念は根拠が薄く、関連性の高い外部参照はむしろプラスに働く傾向があります。

インバウンドリンク

インバウンドリンクとは、外部サイトから自社サイトへ向かうリンクのことです。

一般には被リンクとほぼ同義で使われます。関連性の高いサイトからのリンクは、評価や発見性の向上につながる可能性があります。

質の高いインバウンドリンクを獲得するには、独自調査データや業界分析レポート、便利なツール・テンプレートの無料提供など、「引用したくなる素材」を作ることが有効です。Google Search Consoleの「リンク」レポートで、外部サイトからのリンク状況を確認できます。

質の高いインバウンドリンクを獲得するには、独自調査データや業界分析レポート、便利なツール・テンプレートの無料提供など、「引用したくなる素材」を作ることが有効です。Google Search Consoleの「リンク」レポートで、外部サイトからのリンク状況を確認できます。

外部リンク

外部リンクとは、異なるドメイン間をつなぐリンク全般を指します。

自社から他社へ向かうリンクも、他社から自社へ向かうリンクも含まれます。リンクの向きによって、アウトバウンドリンク、インバウンドリンクと呼び分けると整理しやすいです。

実務では、外部リンクを発リンク(自社→他社)と被リンク(他社→自社)に分けて管理するのが基本です。発リンクは内容の信頼性を補完する効果があり、被リンクは検索エンジンからの評価向上に直結します。外部リンクの品質チェックには、AhrefsやMajesticなどのツールが広く利用されています。

相互リンク

相互リンクとは、2つのサイトまたはページがお互いにリンクを張り合うことです。

関連性が高く、ユーザーにとって自然な導線なら問題ありません。ただし、順位操作だけを目的に大量に行うと不自然になりやすく、評価を落とす要因にもなります。

実務で問題になりやすいパターンとして、関連性のないサイト同士での大量相互リンク、リンク交換だけを目的としたパートナーページの設置などがあります。一方、取引先や関連サービスとの自然な相互紹介は問題なく、読者にとって有益な導線になりえます。

実務で問題になりやすいパターンとして、関連性のないサイト同士での大量相互リンク、リンク交換だけを目的としたパートナーページの設置などがあります。一方、取引先や関連サービスとの自然な相互紹介は問題なく、読者にとって有益な導線になりえます。

スパムリンク

スパムリンクとは、検索順位の操作を目的として作られた不自然・低品質なリンクのことです。

内容の薄いリンク集、無関係な海外サイト、意味不明な自動生成ページからのリンクなどが典型例です。現在は多くが自動的に無視される傾向がありますが、明らかに不自然なリンク獲得は避けるべきです。

自社サイトにスパムリンクが大量に付いている場合は、Google Search Consoleの否認ツール(Disavow Links Tool)で対処できます。ただし、Googleは多くのスパムリンクを自動的に無効化しているため、明確な被害がない限り否認ツールの使用は慎重に判断すべきです。定期的にバックリンクプロファイルを確認し、不審なリンクの急増がないかモニタリングする習慣を持つことが重要です。

内部リンク

内部リンクとは、同一サイト内のページ同士をつなぐリンクです。

関連ページへ自然につなぐことで、ユーザーの回遊を助け、クローラーにもサイト構造を伝えやすくなります。古い記事が孤立している、関連記事が自動表示任せになっている、といった状態は見直し余地が大きいです。

効果的な内部リンク設計のポイントは、関連性の高いページ同士をつなぐこと、アンカーテキストにリンク先の内容を反映させること、重要ページにリンクを集中させること(ハブ構造)です。記事公開後に内部リンクの設置を忘れるケースは多いため、新規記事公開時に既存記事からのリンク追加もセットで行いましょう。

ナチュラルリンク

ナチュラルリンクとは、外部サイトが自発的に価値を感じて設置した自然な被リンクです。

自作自演や売買ではなく、紹介する理由があるから貼られるリンクを指します。調査データ、独自ノウハウ、便利な比較表などは、ナチュラルリンクの獲得につながりやすい素材です。

実務でナチュラルリンクを獲得しやすいコンテンツの特徴として、独自データや調査結果を含む記事、図解やインフォグラフィック、無料ツールやテンプレートの提供などが挙げられます。リンクビルディングの施策としては、コンテンツPR、業界メディアへの寄稿、専門家インタビュー記事の公開などが有効です。

発リンク

発リンクとは、あるページから別ページへ向かって出ていくリンクのことです。

内部リンクも外部リンクも含めて使われることがありますが、文脈によっては外部向けリンクを指す場合もあります。意味が曖昧になりやすいため、実務では内部リンク・外部リンクと分けて呼ぶほうが分かりやすいです。

発リンクは、内部リンクと外部リンクの両方を含む概念です。内部リンクとしての発リンクは、サイト内の回遊性向上とクローラビリティ改善に、外部リンクとしての発リンクは、情報の信頼性担保とユーザー利便性の向上に寄与します。1ページあたりの発リンク数に厳密な上限はありませんが、過度に多いと重要なリンクの価値が分散するため注意が必要です。

被リンク

被リンクとは、外部サイトから自社サイトへ向けて張られたリンクのことです。

SEOでは重要な外部評価要素の一つですが、量より質が重要です。関連性が高く、文脈のあるリンクほど価値があります。逆に、売買や自作自演で増やしたリンクはリスクになります。

被リンクの質を判断する際は、リンク元サイトのテーマとの関連性、リンク元ページの信頼性、リンクが設置されている文脈(本文中のナチュラルなリンクか、フッターの一覧リンクか)などが指標になります。Google Search Consoleの「リンク」レポートや、Ahrefs等のツールで自社の被リンク状況を定期的に確認することを推奨します。

ペイドリンク

ペイドリンクとは、金銭や対価のやり取りによって設置されるリンクのことです。

広告やスポンサー施策そのものが問題なのではなく、適切なrel属性を付けずにランキング操作目的で扱うことが問題になります。検索順位を上げるためのリンク購入は避けるべきです。

具体的にペイドリンクとみなされやすいパターンとして、記事広告やスポンサーコンテンツでrel="sponsored"を付けていないリンク、リンク掲載を条件とした無料商品提供、リンクファームへの参加などがあります。広告やスポンサーシップ自体は問題ではなく、適切なrel属性(sponsored、nofollow)を付与することでガイドラインに準拠した運用が可能です。

リンク切れ

リンク切れとは、設置されたリンク先が存在せず、クリックしても正常に遷移できない状態です。

ユーザー体験を損ねるだけでなく、クローラーの巡回効率にも悪影響を与えます。特に複数担当者で更新するサイトでは、本文だけでなくCTA、ヘッダー、フッター、パンくずなど管理箇所をまとめて確認することが重要です。

リンク切れの定期チェックには、Screaming Frog、Ahrefs、Dead Link Checkerなどのツールが利用できます。WordPressの場合、Broken Link Checkerプラグインで自動検出する方法もあります。リンク切れを放置すると、クローラーのクロールバジェットを無駄遣いし、ユーザー体験の低下にもつながるため、月次での確認を運用フローに組み込むことを推奨します。

リンクジュー���

リンクジュースとは、あるページから別のページへリンクを通じて渡される検索エンジンの評価(ランキングシグナル)を比喩的に表した用語です。

Googleの公式用語ではありませんが、SEO実務では広く使われています。被リンク元のページの評価が高いほど、リンクジュースも大きくなると考えられています。

1つのページから複数のリンクがある場合、リンクジュースは分散されます。そのため、重要なページに内部リンクを集中させる設計や、不要なページへのリンクにnofollowを付ける(ただし効果は限定的)といった施策が議論されます。

aタグ(アンカータグ)

aタグとは、HTMLでハイパーリンクを作成するためのタグで、<a href="URL">テキスト</a> の形式で記述します。

SEOにおいては、aタグのhref属性に指定するURLとアンカーテキスト(リンクテキスト)の両方が重要です。適切なアンカーテキストは、リンク先の内容をユーザーと検索エンジンの双方に伝える役割を果たします。

target="_blank"で別タブを開く設定や、rel="nofollow"でリンク評価の受け渡しを制御する設定など、SEOに影響する属性も複数あります。SEO実務では、aタグにrel属性(nofollow、sponsored、ugc)を適切に設定することが核となります。

リンクジュース

リンクジュースとは、あるページから別のページへリンクを通じて渡される検索エンジンの評価(ランキングシグナル)を比喩的に表した用語です。

Googleの公式用語ではありませんが、SEO実務では広く使われています。被リンク元のページの評価が高いほど、リンクジュースも大きくなると考えられます。

1つのページから複数のリンクがある場合、リンクジュースは分散されます。そのため、重要なページに内部リンクを集中させる設計や、不要なページへのリンクにnofollowを付ける(ただし効果は限定的)といった施策が議論されます。

SEOでやってはいけないことに関する用語

SEOは、検索エンジンの仕組みを理解して最適化する施策ですが、順位操作だけを目的にするとガイドライン違反になりやすくなります。ここでは避けたい代表例を整理します。

インタースティシャル広告

インタースティシャル広告とは、ページ閲覧の途中や直後に、画面の大部分を覆う形で表示される広告です。

視認性は高い一方で、ユーザーが見たい情報を妨げやすく、モバイルでは特にストレスになりやすいです。

ユーザーの閲覧を妨げる表示は、ページ体験の悪化につながるため、SEOでも注意が必要です。

Googleは、モバイルでページコンテンツにアクセスしにくくなるインタースティシャルに対してランキング低下の措置を取る場合があると公式に示しています。年齢確認やCookie同意など法的に必要なインタースティシャルは例外として扱われます。ポップアップを使う場合は、画面面積の小さいバナー型にするか、一定時間経過後に表示するなどの工夫が推奨されます。

隠しテキスト・リンク

隠しテキスト・リンクとは、ユーザーには見えにくく、検索エンジンだけに認識させる目的で配置されたテキストやリンクです。

以下のようなものが例として挙げられます。

- 文字を白にして見えにくくする

- 背景色と文字色を同じにして隠す

- 画像の背後にテキストを設置する

- フォントサイズを極端に小さくする、または透明にして見えない状態にする

- ドット(.)やハイフン(-)のみにリンクを貼る

CSSやHTMLの実装ミスで意図せず近い状態になることもあるため、デザイン変更時は表示確認まで行うことが大切です。

カニバリゼーション

カニバリゼーションとは、同じ検索意図を狙う複数ページが自サイト内で競合してしまう状態です。

似た記事を増やしすぎると、どのページを評価すべきかが曖昧になり、順位が安定しにくくなります。新規作成前に既存記事との役割分担を確認することが重要です。

発見の方法として、Google Search Consoleで同じクエリに対して複数のURLが表示されている場合、カニバリゼーションが起きている可能性があります。対策としては、(1)片方の記事をもう一方に統合する、(2)canonicalタグで正規ページを指定する、(3)各ページの検索意図を明確に差別化する、といった方法があります。

キーワードスタッフィング

キーワードスタッフィングとは、対策キーワードを不自然なほど繰り返し詰め込むことです。

SEOを意識するあまり、タイトル、見出し、本文に同じ語句を過剰に入れると、かえって読みづらくなります。自然な日本語で、必要な場所に適切に入れることが基本です。

以前は「キーワード出現率○%が最適」という考え方もありましたが、現在のアルゴリズムでは自然な文脈でキーワードが使われているかが重視されます。タイトルや見出しに同じキーワードを何度も入れるのは逆効果であり、類義語や関連表現を織り交ぜて自然な日本語にすることが、結果的にSEO効果を高めます。

クローキング

クローキングとは、ユーザーに見せる内容と検索エンジンに見せる内容を意図的に変える行為です。

検索順位を上げるためだけに、クローラー向けに別内容を出し分けるのは問題になります。一方で、レスポンシブ対応やログイン制御のように、ユーザー体験や機能上必要な差分まで直ちに問題になるわけではありません。

実務で意図せずクローキングに近い状態になりやすい例として、JavaScriptレンダリングの問題でクローラーとユーザーに異なるコンテンツが表示されるケース、ABテストでGooglebotに特定のバリエーションを出し分けるケースなどがあります。Google Search Consoleの「URL検査」で、Googlebotが取得したページとユーザー表示の差異を確認できます。

クリックベイト

クリックベイトとは、内容以上に煽ったタイトルや画像でクリックを誘う手法です。

本文で答えないのに「絶対に知らない」「今すぐ見ないと損」のような表現を多用すると、クリック後の満足度が下がりやすくなります。

短期的なCTRより、クリック後に期待を裏切らないことのほうが長期的には重要です。

対策としては、タイトルで期待させた内容を本文で確実に回答すること、誇張表現を避けて具体的な情報を示すことが基本です。AIによるコンテンツ大量生成の時代では、タイトルと内容の一貫性がより厳しく評価される傾向にあり、クリックベイト的な手法のリスクは以前より高まっています。

重複コンテンツ

重複コンテンツとは、ページ全体または大部分の内容が他ページとほぼ同じ状態を指します。

意図的なコピーはもちろん問題ですが、ECのバリエーションページ、地域名だけ差し替えた店舗紹介、並び替えURLなど、意図せず重複に近い状態が生まれることもあります。悪質でなくても評価分散の原因になるため、正規化や統合を検討することが大切です。

対策の優先度としては、(1)canonicalタグで正規URLを指定する、(2)不要なURLバリエーションを301リダイレクトで統合する、(3)robots.txtやnoindexで低品質な重複ページをインデックスから除外する、という順で対応するのが一般的です。サイト内の重複コンテンツの発見には、Screaming Frogなどのクロールツールが有効です。

ブラックハットSEO

ブラックハットSEOとは、ガイドライン違反や不正な手法で検索順位を操作しようとする施策の総称です。

リンク売買、隠しテキスト、クローキング、大量生成ページなどが代表例です。2026年時点では、生成AIを使った大量ページ作成も、価値を加えずに量産すれば問題になりえます。

検索エンジンのガイドラインは年々精緻化されており、以前は通用したグレーゾーンの施策も現在ではスパムとして検出されやすくなっています。ホワイトハットSEO(ガイドラインに準拠した正当な施策)に一貫して取り組むことが、長期的なSEO成果の基盤です。

ペナルティ

ペナルティとは、ガイドライン違反により検索結果で不利益を受ける状態を指します。

手動対策として通知される場合もあれば、アルゴリズム上の評価低下として現れる場合もあります。公開本数は増えているのに全体評価が伸びない、一部ディレクトリだけ急に落ちる、といった形で異変が出ることもあります。

手動対策を受けた場合はGoogle Search Consoleに通知が届き、原因の修正後に「再審査リクエスト」を送ることで解除を申請できます。アルゴリズムによる評価低下の場合は通知がなく、原因の特定が難しいため、定期的な順位モニタリングとサイト全体の品質チェックが重要です。

サテライトサイト

サテライトサイトとは、メインサイトのSEO効果を高める目的で作成される別ドメインのサイトです。

かつては被リンク獲得のために自作のサテライトサイトを量産する手法が広く使われていましたが、現在のGoogleアルゴリズムでは不自然なリンクネットワークとして検出されやすく、ペナルティの対象になるリスクがあ��ます。

一方、独立したコンテンツ価値を持つ関連サイトを運営すること自体はスパムではありません。判断基準は「そのサイトがリンク目的だけで存在しているか、独自の価値を提供しているか」です。

現在のGoogleアルゴリズムでは、リンク目的だけの低品質なサテライトサイトの運用はスパムリンクとして検出されるリスクが高く、メインサイトにもペナルティが波及する可能性があります。独自の価値を持つ関連サイトの運営と、リンク獲得だけが目的のサテライト運用は明確に区別されるべきです。

コピーコンテンツ

コピーコンテンツとは、他サイトのコンテンツを無断で複製・流用したページのことです。重複コンテンツとは異なり、意図的な盗用を指します。

Googleはオリジナルのコンテンツを評価し、コピーコンテンツは検索結果から排除する傾向があります。悪質な場合は手動対策(ペナルティ)の対象にもなります。

自社コンテンツが他サイトにコピーされた場合は、Google Search Consoleの「著作権侵害の報告」やDMCA申請で対処できます。また、自社内で類似コンテンツが生じている場合はcanonicalタグで正規URLを指定する対応が有効です。

逆SEO

逆SEOとは、ネガティブな検索結果(自社の悪評・誹謗中傷など)を、自社が望むコンテンツで上位表示し、相対的に下位へ追いやる対策のことです。

風評被害対策の一手段として用いられます。具体的には、ブランド名で検索された際に問題のある記事より自社の公式情報や好意的なコンテンツが上位に来るよう、コンテンツの拡充とSEO最適化を行います。

ただし、競合サイトに対して悪質な被リンクを送って順位を下げさせるような攻撃的な手法は、Googleのスパムポリシー違反にあたります。当社EXIDEAでも、逆SEOは自社コンテンツの強化による相対順位押し上げを基本方針として推奨しています。

ワードサラダ

ワードサラダとは、意味のない単語を機械的に繋ぎ合わせて、文章の体裁だけを整えた低品質コンテンツのことです。

検索エンジン対策としてキーワードを大量に盛り込むために生成されることがありますが、Googleはスパムと判定し、ペナルティの対象になります。読み手にとって理解できない文章は、検索エンジンにも価値が伝わりません。

AIで生成した文章であっても、ユーザーの役に立つ内容でなければ、実質的に同じ評価を受ける可能性が高いです。AIライティング自体はGoogleが問題視していませんが、人間が読んで意味のある内容になっているか、独自情報や根拠が含まれているかの確認が、現在のSEOでは欠かせません。

ツールやサイトに関する用語

SEO実務では、用語だけでなくツールの役割も理解しておくと判断が速くなります。ここでは代表的なツールやサービスを整理します。

Google Analytics(グーグルアナリティクス)

Google Analyticsとは、Googleが提供するアクセス解析ツールです。

現在の主流はGA4で、ユーザー数、流入経路、エンゲージメント、CVなどを確認できます。SEOでは、自然検索流入後の行動や成果を把握するために欠かせません。

現行のGA4では、セッションベースからイベントベースの計測モデルに変わり、ユーザーの行動をより柔軟に追跡できるようになりました。SEO分析では、「集客」→「トラフィック獲得」でオーガニック検索からの流入を確認し、ランディングページごとのエンゲージメント率やCV数を把握するのが基本的な使い方です。

Google Search Console(グーグルサーチコンソール)

Google Search Consoleとは、検索クエリ、表示回数、クリック数、掲載順位、インデックス状況などを確認できる無料ツールです。

新規ページの登録確認、エラー把握、検索パフォーマンスの分析に役立ちます。SEOでは、まずSearch Consoleを見る習慣を付けるだけでも改善の精度が上がります。

SEO実務での主な活用シーンは、(1)検索パフォーマンス(クエリ・ページごとの表示回数・CTR・平均順位)の分析、(2)インデックスカバレッジの確認、(3)URL検査によるクロール・レンダリング状況の把握、(4)モバイルユーザビリティやCore Web Vitalsの問題検出です。少なくとも週1回はレポートを確認する運用ルールを設けることを推奨します。

Google Discover(グーグルディスカバー)

Google Discoverとは、ユーザーの興味関心に応じて、検索前の段階で記事やページをおすすめ表示する機能です。

検索クエリを明示的に入力しない流入であるため、通常のSEOとは少し性質が異なります。鮮度、視認性、関心の広がりやすいテーマが影響しやすい一方、狙って再現するのは簡単ではありません。

Discoverからの流入を増やすポイントとして、高品質な画像(1200px以上の横幅)の使用、E-E-A-Tの明示、話題性のあるテーマの迅速な発信などが挙げられます。Google Search Consoleの「Discover」レポートで流入状況を確認できますが、Discoverは表示基準が明確に公開されていないため、安定的な流入源としては計画しにくい面があります。

Googleトレンド(グーグルトレンド)

Googleトレンドとは、キーワードの検索関心の推移や季節性を確認できる無料ツールです。

検索ボリュームの絶対値ではなく、相対的な伸びや注目度を見るのに向いています。季節商材、制度改正、話題化しやすいテーマでは特に役立ちます。

実務での活用例として、キーワードの季節変動の把握(例:「エアコン 掃除」は夏前に急増)、複数キーワードの人気度比較、急上昇トピックの発見などがあります。関連クエリ機能を使えば、その検索トピックと一緒に検索されやすいキーワードも把握でき、コンテンツ企画のアイデア出しに役立ちます。

Googleビジネスプロフィール

Googleビジネスプロフィールとは、店舗や拠点の情報をGoogle検索やGoogleマップに表示するための管理ツールです。

営業時間、住所、電話番号、写真、口コミ返信などを整備することで、ローカルSEOに大きく影響します。店舗型ビジネスでは、サイト本体と同じくらい重要になることもあります。

最適化のポイントは、ビジネスカテゴリの正確な設定、営業時間の最新化、写真の定期的な追加、口コミへの丁寧な返信、投稿機能を活用した情報発信です。NAP情報(Name・Address・Phone)は、自社サイト・SNS・ポータルサイトなど全ての掲載先で統一しておくことが、ローカルSEOの基本中の基本です。

PageSpeed Insights(ページスピードインサイト)

PageSpeed Insightsとは、Webページの表示速度や改善点を確認できるGoogleの無料ツールです。

モバイルとPCの両方で計測でき、実ユーザーデータとラボデータを分けて見られます。点数だけに一喜一憂するより、LCPやINP、CLSなど個別指標と改善項目を見るほうが実務では有効です。

表示される指標のうち、LCP(最大コンテンツの表示時間)とINP(操作応答性)は特にSEOに影響しやすいため、優先的に改善すべきです。よくある改善施策として、画像のWebP変換、遅延読み込み(lazy loading)、未使用JavaScriptの削除、CDN(コンテンツ配信ネットワーク)の導入などがあります。

WordPress(ワードプレス)

WordPressとは、Webサイトやブログを管理しやすくするCMSの一つです。

テーマやプラグインが豊富で、比較的低コストでサイト運営を始めやすいのが特徴です。一方で、プラグインの入れすぎや設定競合により、titleタグやサイトマップの二重生成などSEO上の問題が起きることもあります。

SEO向けのプラグインとしては、Yoast SEO、Rank Math、All in One SEO Packなどが広く使われています。ただし、プラグインを入れるだけではSEO効果は得られず、サイト構造の設計やコンテンツの質が前提です。セキュリティアップデートやプラグインの互換性管理も運営上の重要なポイントであり、放置すると表示崩れやインデックス不具合の原因になることがあります。

Microsoft Copilot(コパイロット)

Microsoft Copilotとは、Microsoftが提供するAIアシスタントで、Bing検索、Microsoft 365、Windowsなどに統合され��います。

Bingの検索結果にAI生成の回答を表示する機能が代表的です。SEOの観点では、Google以外の検索エンジン・AIプラットフォームへの対応として注目されています。

特にBtoB領域やWindows環境の多い企業では、Bing経由の流入が無視できない割合を占めることもあります。構造化データの整備やE-E-A-Tの強化は、Google以外のAI検索エンジンへの対策としても有効です。

その他

SEO対策のために知っておきたい用語をご紹介しました。

最後は、SEO用語そのものではありませんが、Google検索の進化を理解するうえでよく話題に上がる代表的なアルゴリズムアップデートを3つご紹介します。

ハミングバードアップデート

ハミングバードアップデートは、会話的な検索や文脈理解を強化し、検索意図に合う結果を返しやすくした大きな改善として知られています。

単語の一致だけでなく、クエリ全体の意味を捉える方向へ進んだ転換点として語られることが多いです。現在の自然言語理解の流れを考えるうえでも、背景として押さえておくと役立ちます。

2013年に導入されたこのアップデートは、検索エンジンが「単語の組み合わせ」ではなく「質問の意味」を理解する方向へ進んだ大きな転換点でした。後にRankBrain、BERT、MUMといった自然言語理解技術につながる基盤としても位置づけられています。

パンダアップデート

パンダアップデートは、低品質コンテンツの評価を下げる方向で知られるアップデートです。

内容の薄いページや、広告過多、独自性の乏しい量産ページが問題視される流れを強めました。2026年のSEOでも、この考え方は形を変えて続いており、独自性不足のページは伸びにくい傾向があります。

2011年に初めて導入されたパンダアップデートは、コンテンツの品質評価を体系化する流れを作りました。現在のHelpful Content Systemや、E-E-A-Tの評価基準も、この延長線上にある考え方です。コンテンツを量産する際は、1記事ごとに独自の価値があるかを自問することが、パンダ的な評価低下を避ける基本です。

ペンギンアップデート

ペンギンアップデートは、不自然なリンク施策やスパム的な外部対策を抑制する方向で知られるアップデートです。

自作自演リンク、リンク売買、過剰なアンカーテキスト最適化などが問題視されました。現在も、リンクは重要である一方、獲得方法の自然さが問われる点は変わっていません。

2012年に初めて導入され、2016年からはGoogleの通常アルゴリズムに統合されてリアルタイムで動作しています。現在のリンクスパム対策(SpamBrain等)はペンギンの考え方を継承・発展させたもので、不自然なリンクパターンの検出精度は年々向上しています。

音声検索SEO

音声検索SEOとは、スマートスピーカーやスマートフォンの音声アシスタント(Googleアシスタント、Siri、Alexaなど)で行われる検索に対応したSEOのことです。

音声検索は会話調のロングテールキーワードが中心で、「〜とは」「〜の方法」のような自然な質問形式に最適化することが効きます。FAQ構造化データやスニペット最適化も、音声検索で読み上げられるための準備として効果があります。

スマートスピーカーの普及やモバイル端末の音声入力増加に伴い、検索クエリの長文化・会話化が進んでいます。コンテンツ側では、Q&A形式のセクション、自然文での回答、結論を冒頭に置く構成が、音声検索でも引用されやすくなります。

当社EXIDEAが考えるSEO用語の身につけ方

当社では、SEO用語の理解は「知識として覚える」のではなく、実務でつまずいたときに調べて、自社の文脈で使えるようになる形で身につけるのが現実的だと考えています。SEO用語は数百あり、すべてを暗記しても運用には直結しません。

運用の基本動作は3つあります。1つ目は、自社の課題に直結する用語から覚えること。たとえば「インデックスされない」が課題なら、まずインデックス・クロール・サイトマップ・robots.txt・noindex の関連用語を、その課題を解決するための語彙として把握する。すると単なる暗記ではなく、運用で使える知識として定着します。

2つ目は、Googleの公式ドキュメントの語彙に揃えること。日本のSEO業界では用語の意味が微妙に揺れることがあり、ベンダーや書籍によって定義が違うケースもあります。迷ったら、Google検索セントラル(developers.google.com/search)で公式の言い回しを確認する。これが当社のクライアント支援でも基本動作です。

3つ目は、新しい用語(LLMO・AI Overview・E-E-A-T等)を継続的に追うこと。SEOは検索エンジンの進化に合わせて新しい概念が増え続けます。古い用語集だけ覚えていると、AI検索時代の議論に追いつけません。当社のオウンドメディアでも、定期的に新規用語を追加してアップデートしています。

よくある質問

SEO用語は全部覚えないといけませんか?

すべて暗記する必要はありません。まずはインデックス、クローリング、検索意図、内部リンク、E-E-A-T、リライトのような実務で頻出する言葉から押さえると十分です。

初心者が最初に覚えるべきSEO用語は何ですか?

SEO、インデックス、クローラー、検索クエリ、オーガニック検索、SERP、内部リンク、タイトル、ディスクリプションあたりから始めると理解しやすいです。まずは検索結果に出るまでの流れをつかむことがおすすめです。

SEO用語集はどのように使うと効率的ですか?

分からない言葉が出たときに都度引く使い方が基本です。加えて、サイト改善や記事作成の前に一通り眺めておくと、施策の全体像をつかみやすくなります。

2026年時点で特に重要なSEO用語は何ですか?

E-E-A-T、検索意図、構造化データ、コアウェブバイタル、モバイル対応、リライト、内部リンク、サイテーションあたりは特に重要です。AI活用が進んだ分、独自性や信頼性に関わる用語の重要度が上がっています。

まとめ

SEO用語集は、単なる言葉の辞書ではなく、SEO施策の全体像を理解するための土台になります。

特に2026年のSEOでは、用語を知っているだけでなく、その言葉がどの施策判断につながるのかまで理解しておくことが重要です。インデックスや内部リンクのような技術面、E-E-A-Tや検索意図のような品質面、CVやCTAのような成果面をつなげて考えると、実務で迷いにくくなります。

知らない言葉が出てきたときにすぐ確認できるよう、このページを手元に置きながら活用してみてください。SEOの全体像や具体的な進め方まで整理したい方は、以下のページもあわせて確認してみましょう。